Robustezza del Modello

La robustezza del modello garantisce che i modelli di apprendimento automatico funzionino in modo affidabile e accurato, anche di fronte a variazioni dei dati, attacchi avversari e incertezze del mondo reale.

La robustezza del modello si riferisce alla capacità di un modello di apprendimento automatico (ML) di mantenere prestazioni coerenti e accurate nonostante variazioni e incertezze nei dati di input. Questo concetto è centrale per garantire che i modelli di IA funzionino in modo affidabile nelle applicazioni del mondo reale, dove i dati possono differire significativamente dai dataset di addestramento. I modelli robusti sono progettati per gestire rumore, outlier, cambiamenti di distribuzione e attacchi avversari, preservando così la loro accuratezza predittiva e funzionalità in condizioni diverse.

Comprendere la Robustezza del Modello

Nel contesto dell’apprendimento automatico, la robustezza non riguarda solo l’ottenimento di un’alta accuratezza sui dati di addestramento, ma garantisce che il modello possa generalizzare bene a nuovi dati mai visti prima, spesso provenienti da distribuzioni differenti. Questa capacità è fondamentale per applicazioni in cui accuratezza e stabilità delle previsioni sono essenziali, come la guida autonoma, la diagnostica sanitaria e le previsioni finanziarie.

Aspetti Chiave della Robustezza del Modello

- Robustezza dei Dati: Garantisce che il modello possa gestire input vari e potenzialmente rumorosi, mantenendo le prestazioni senza degrado sostanziale.

- Robustezza agli Attacchi Avversari: La capacità del modello di resistere a manipolazioni tramite attacchi avversari, che cercano di sfruttare vulnerabilità introducendo sottili perturbazioni ai dati di input.

Importanza della Robustezza del Modello

La rilevanza della robustezza del modello è molteplice, soprattutto perché i sistemi di IA vengono impiegati sempre più spesso in applicazioni critiche e sensibili:

- Generalizzazione: Un modello robusto si comporta bene su dati mai visti prima, catturando schemi sottostanti piuttosto che memorizzare il set di addestramento.

- Coerenza delle Prestazioni: I modelli robusti forniscono previsioni affidabili in diversi scenari, fondamentale in campi dove le decisioni basate sulle previsioni del modello hanno conseguenze significative.

- Resilienza agli Attacchi Avversari: I modelli robusti aumentano la sicurezza resistendo ai tentativi di manipolazione delle previsioni tramite input manipolati.

- Equità e Riduzione dei Bias: I modelli robusti hanno meno probabilità di mostrare previsioni distorte, poiché sono addestrati su dataset diversificati e rappresentativi.

Come Ottenere la Robustezza del Modello

Raggiungere la robustezza richiede una combinazione di strategie e tecniche volte a migliorare la capacità del modello di generalizzare e resistere a condizioni avverse.

Tecniche e Approcci

- Qualità e Aumento dei Dati: Garantire dati di addestramento di alta qualità, vari e rappresentativi è fondamentale. L’aumento dei dati introduce variabilità nel set di addestramento, aiutando il modello a gestire scenari diversi.

- Regolarizzazione e Complessità del Modello: Tecniche come la regolarizzazione L1/L2, il dropout e l’early stopping prevengono l’overfitting limitando la complessità del modello, incoraggiandolo a concentrarsi sulle caratteristiche più rilevanti.

- Addestramento Avversario: Prevede l’addestramento del modello su esempi avversari per migliorarne la resilienza agli attacchi.

- Apprendimento Ensemble: Combinare più modelli con punti di forza differenti per creare un sistema complessivamente più robusto. Questo approccio bilancia le debolezze dei singoli modelli.

- Transfer Learning e Adattamento di Dominio: Il transfer learning permette a un modello addestrato su un compito di adattarsi a un compito correlato, mentre l’adattamento di dominio aiuta i modelli a gestire cambiamenti di distribuzione.

- Test e Validazione della Robustezza: Eseguire test di robustezza approfonditi per valutare e migliorare la resilienza del modello a tattiche avversarie e cambiamenti nei dati.

Sfide nel Raggiungimento della Robustezza

Nonostante l’importanza della robustezza, permangono diverse sfide nello sviluppo di modelli di apprendimento automatico robusti:

- Evoluzione delle Tattiche Avversarie: Poiché le tecniche avversarie diventano più sofisticate, i modelli devono adattarsi continuamente per contrastare nuove minacce.

- Complessità del Modello: Garantire la robustezza spesso aumenta la complessità del modello, creando sfide in termini di interpretabilità e debugging.

- Costi Computazionali: I modelli robusti possono richiedere risorse computazionali estese per l’addestramento, soprattutto quando si utilizzano tecniche come l’addestramento avversario.

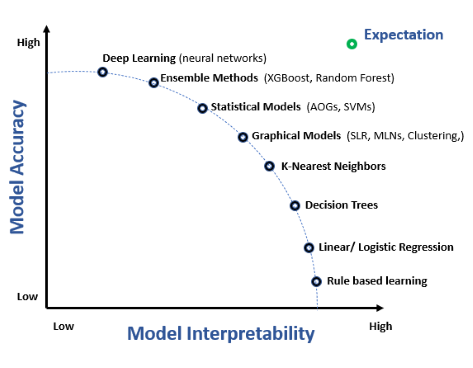

- Bilanciare Accuratezza e Robustezza: Trovare il giusto equilibrio tra il mantenimento di un’elevata accuratezza e la garanzia della robustezza può essere una sfida.

Casi d’Uso ed Esempi

I modelli robusti trovano applicazione in diversi settori, dove sono cruciali per garantire affidabilità e fiducia:

- Veicoli Autonomi: I modelli robusti nelle auto a guida autonoma devono interpretare accuratamente i dati dei sensori in condizioni variabili per garantire la sicurezza dei passeggeri.

- Sanità: Nella diagnostica medica, i modelli robusti forniscono previsioni coerenti e accurate su dati di pazienti diversi, supportando decisioni affidabili.

- Cybersecurity: I modelli di IA robusti rilevano e neutralizzano gli attacchi avversari, proteggendo dati e operazioni sensibili.

Ricerca sulla Robustezza del Modello

La robustezza del modello è un aspetto cruciale dell’apprendimento automatico che riguarda la capacità di un modello di mantenere le proprie prestazioni quando è soggetto a perturbazioni o attacchi avversari. Di seguito sono presentati i riassunti di alcuni importanti articoli scientifici che esplorano differenti approcci per migliorare la robustezza dei modelli:

1. Robust Proxy: Improving Adversarial Robustness by Robust Proxy Learning

- Autori: Hong Joo Lee, Yong Man Ro

- Pubblicato: 2023-06-27

- Sintesi: Questo articolo affronta la vulnerabilità delle reti neurali profonde (DNN) agli attacchi avversari e propone un nuovo framework di addestramento chiamato Robust Proxy Learning. Gli autori dimostrano che è possibile apprendere rappresentazioni robuste delle caratteristiche utilizzando feature robuste rappresentative della classe. Introdurre perturbazioni robuste per classe permette al modello di generare queste caratteristiche e utilizzarle come proxy robusti. Esperimenti approfonditi mostrano che questo approccio migliora la robustezza avversaria delle DNN. L’articolo contribuisce alla comprensione dell’apprendimento di rappresentazioni robuste agli attacchi avversari.

Leggi di più

2. Revisiting Adversarial Robustness Distillation: Robust Soft Labels Make Student Better

- Autori: Bojia Zi, Shihao Zhao, Xingjun Ma, Yu-Gang Jiang

- Pubblicato: 2021-08-18

- Sintesi: Questo studio esplora l’uso della knowledge distillation per migliorare la robustezza dei modelli piccoli contro gli attacchi avversari. Gli autori propongono un metodo chiamato Robust Soft Label Adversarial Distillation (RSLAD), che sfrutta etichette soft robuste da un grande modello insegnante addestrato avversarialmente. RSLAD guida l’addestramento di modelli studenti piccoli sia su esempi naturali che avversari. L’articolo dimostra l’efficacia di RSLAD nel migliorare la robustezza di modelli piccoli, soprattutto in scenari con risorse limitate come i dispositivi mobili.

Leggi di più

3. The Pros and Cons of Adversarial Robustness

- Autori: Yacine Izza, Joao Marques-Silva

- Pubblicato: 2023-12-18

- Sintesi: Questo articolo presenta un’analisi del problema fondamentale della robustezza avversaria nei modelli di apprendimento automatico. Discute l’importanza della robustezza, sia a livello locale che globale, e mette in evidenza i progressi e le sfide in corso nel settore. Lo studio sottolinea il ruolo delle competizioni e dei benchmark nella valutazione dell’efficacia degli strumenti e degli approcci di robustezza, fornendo spunti sulle implicazioni della robustezza avversaria nelle applicazioni reali.

Leggi di più

Domande frequenti

- Che cos'è la robustezza del modello nell'apprendimento automatico?

La robustezza del modello è la capacità di un modello ML di mantenere prestazioni affidabili e accurate anche quando affronta variazioni, rumore o attacchi avversari nei dati di input. Garantisce che i modelli generalizzino bene a dati nuovi o reali.

- Perché è importante la robustezza del modello?

La robustezza è essenziale perché i dati reali spesso differiscono da quelli di addestramento. I modelli robusti forniscono previsioni coerenti, resistono agli attacchi avversari, riducono i bias e assicurano risultati affidabili in applicazioni critiche come sanità, finanza e veicoli autonomi.

- Come posso migliorare la robustezza del mio modello di IA?

Puoi aumentare la robustezza utilizzando l'aumento dei dati, tecniche di regolarizzazione, addestramento avversario, apprendimento ensemble, transfer learning e test approfonditi di robustezza per assicurarti che il tuo modello funzioni bene in diversi scenari.

- Cosa sono gli attacchi avversari nell'IA?

Gli attacchi avversari sono manipolazioni deliberate dei dati di input progettate per ingannare i modelli di IA e indurli a fare previsioni errate. I modelli robusti utilizzano tecniche come l'addestramento avversario per resistere a tali attacchi e mantenere prestazioni accurate.

Inizia a Costruire Soluzioni di IA Robuste

Scopri come FlowHunt può aiutarti a progettare, testare e distribuire modelli di IA robusti per prestazioni affidabili nel mondo reale in tutti i settori.