Integrazione del Server MCP di Replicate

Integra l’ampio catalogo di modelli AI di Replicate nei tuoi progetti FlowHunt. Cerca, esplora ed esegui modelli facilmente tramite il connettore Replicate MCP Server.

Che cosa fa il Server MCP “Replicate”?

Il Server MCP di Replicate è un server Model Context Protocol (MCP) progettato per fornire accesso diretto all’API di Replicate per assistenti e client AI. Collegando i modelli AI con l’ampio hub di modelli di Replicate, consente agli utenti di cercare, esplorare e interagire con diversi modelli di machine learning direttamente dai propri flussi di sviluppo. Il server supporta attività come ricerca semantica dei modelli, recupero dettagli, esecuzione di predizioni e gestione delle collezioni. Questo permette agli sviluppatori di sperimentare rapidamente e distribuire capacità AI come generazione di immagini, analisi di testo e altro, mantenendo al contempo un accesso sicuro tramite token API e interfacce di strumenti standardizzate.

Elenco dei Prompt

Nessun template di prompt è esplicitamente menzionato nella documentazione o nel codice del repository.

Elenco delle Risorse

Non sono descritte risorse MCP esplicite nella documentazione o nel codice disponibile.

Elenco degli Strumenti

- search_models: Trova modelli tramite ricerca semantica.

- list_models: Sfoglia i modelli disponibili su Replicate.

- get_model: Ottieni informazioni dettagliate su un modello specifico.

- list_collections: Sfoglia le collezioni di modelli.

- get_collection: Ottieni dettagli su una specifica collezione di modelli.

- create_prediction: Esegui un modello selezionato con input forniti dall’utente.

Casi d’Uso di questo Server MCP

- Scoperta Modelli AI: Gli sviluppatori possono usare la ricerca semantica e le funzioni di esplorazione per trovare rapidamente modelli adatti alle proprie esigenze, accelerando la sperimentazione e il prototipaggio.

- Recupero Informazioni Modello: Recupera facilmente dettagli e cronologia delle versioni dei modelli, supportando decisioni informate nell’integrazione o distribuzione dei modelli.

- Esecuzione di Predizioni: Esegui modelli direttamente tramite l’interfaccia degli strumenti MCP, abilitando attività come generazione di immagini, trasformazione di testo e altro da piattaforme AI compatibili.

- Gestione Collezioni: Accedi e organizza collezioni di modelli, facilitando la gestione e la cura di modelli rilevanti per team o progetti.

- Automazione dei Flussi di Lavoro: Integra le funzionalità di Replicate nei flussi di sviluppo automatizzati, riducendo il lavoro manuale e ottimizzando compiti AI ripetitivi.

Come configurarlo

Windsurf

- Assicurati che Node.js sia installato.

- Ottieni il tuo token API Replicate dalla pagina dei token API di Replicate.

- Aggiungi la configurazione MCP al file delle impostazioni di Windsurf:

{ "mcpServers": { "replicate": { "command": "mcp-replicate", "env": { "REPLICATE_API_TOKEN": "your_token_here" } } } } - Salva le impostazioni e riavvia Windsurf.

- Verifica che il server MCP di Replicate sia disponibile nella tua interfaccia.

Claude

- Installa il server globalmente:

npm install -g mcp-replicate - Ottieni il tuo token API Replicate.

- Apri le Impostazioni di Claude Desktop e vai alla sezione “Sviluppatore”.

- Clicca su “Modifica Config” e aggiungi:

{ "mcpServers": { "replicate": { "command": "mcp-replicate", "env": { "REPLICATE_API_TOKEN": "your_token_here" } } } } - Salva e riavvia Claude Desktop. Cerca l’icona dello strumento martello per confermare.

Cursor

- Installa Node.js e ottieni il tuo token API Replicate.

- Nella configurazione di Cursor, aggiungi:

{ "mcpServers": { "replicate": { "command": "mcp-replicate", "env": { "REPLICATE_API_TOKEN": "your_token_here" } } } } - Salva e riavvia Cursor per attivare il server.

Cline

- Assicurati che Node.js sia installato e il tuo token API Replicate sia pronto.

- Aggiorna il file di configurazione di Cline:

{ "mcpServers": { "replicate": { "command": "mcp-replicate", "env": { "REPLICATE_API_TOKEN": "your_token_here" } } } } - Salva le modifiche e riavvia Cline.

Nota:

Proteggi sempre le tue chiavi API utilizzando variabili d’ambiente come mostrato negli esempi di configurazione sopra. Evita di inserire dati sensibili in file accessibili pubblicamente.

Esempio con env e inputs

{

"mcpServers": {

"replicate": {

"command": "mcp-replicate",

"env": {

"REPLICATE_API_TOKEN": "your_token_here"

},

"inputs": {}

}

}

}

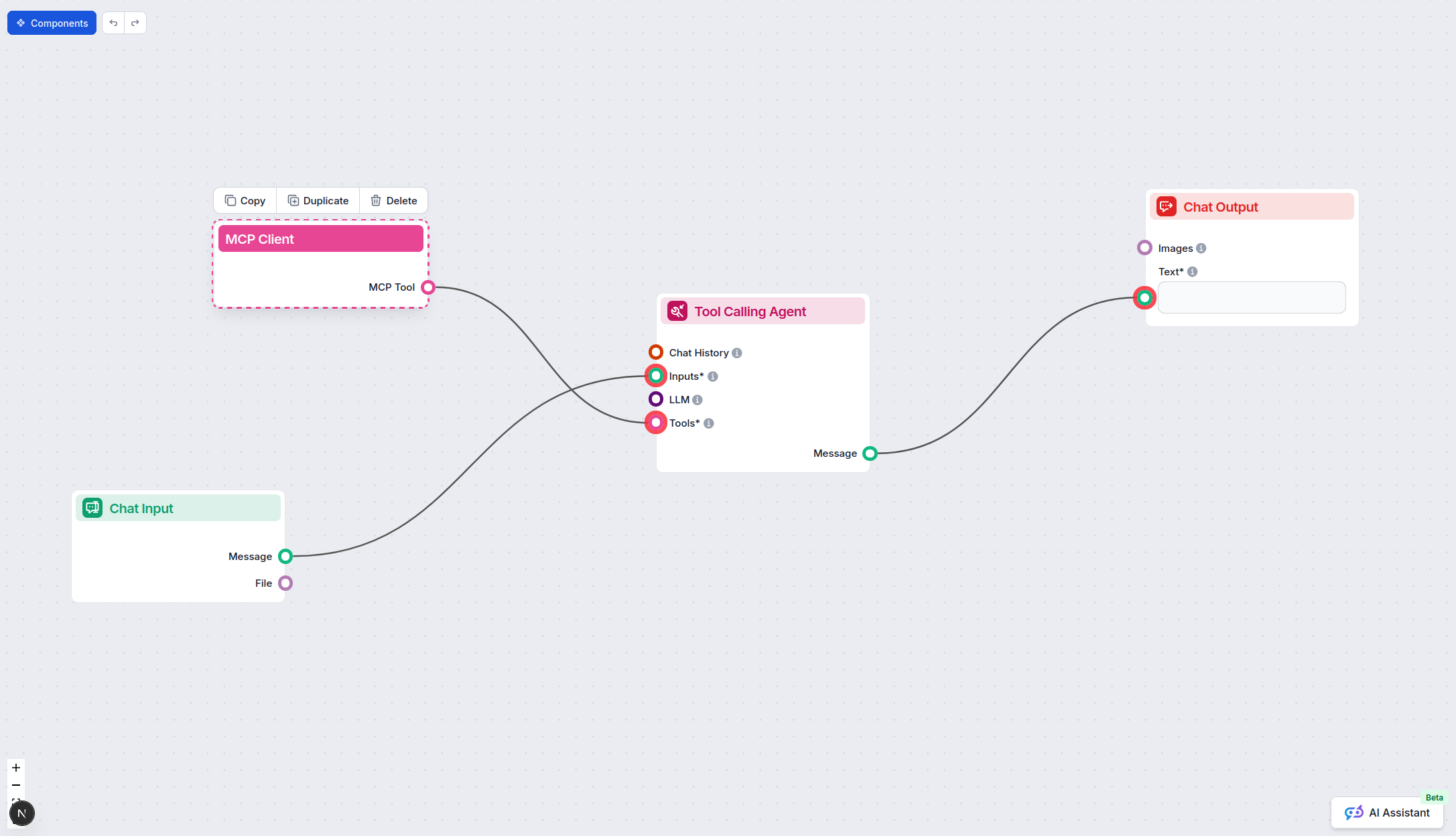

Come usare questo MCP nei flussi

Uso di MCP in FlowHunt

Per integrare i server MCP nel tuo workflow FlowHunt, inizia aggiungendo il componente MCP al tuo flusso e collegandolo al tuo agente AI:

Clicca sul componente MCP per aprire il pannello di configurazione. Nella sezione di configurazione MCP di sistema, inserisci i dettagli del tuo server MCP usando questo formato JSON:

{

"replicate": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Una volta configurato, l’agente AI sarà in grado di utilizzare questo MCP come strumento con accesso a tutte le sue funzioni e capacità. Ricorda di cambiare “replicate” con il vero nome del tuo server MCP e sostituisci l’URL con quello del tuo server MCP.

Panoramica

| Sezione | Disponibilità | Dettagli/Note |

|---|---|---|

| Panoramica | ✅ | |

| Elenco dei Prompt | ⛔ | Nessun template di prompt menzionato nel repo. |

| Elenco delle Risorse | ⛔ | Nessuna risorsa esplicita descritta. |

| Elenco degli Strumenti | ✅ | 6 strumenti per modelli e predizioni. |

| Protezione delle Chiavi API | ✅ | Configurazione tramite env vars, esempi forniti. |

| Supporto Sampling (meno importante in valutazione) | ⛔ | Nessuna menzione di sampling o roots in documentazione. |

Supporto roots: Non specificato nella documentazione disponibile.

In base alle tabelle sopra, il Server MCP di Replicate è ben documentato per l’installazione e l’uso degli strumenti, ma manca di template di prompt e risorse MCP esplicite. Il supporto per sampling e roots non è menzionato. Per gli sviluppatori che cercano accesso all’API Replicate tramite MCP, è una scelta solida se il focus è sulla scoperta dei modelli e sugli strumenti di predizione, ma risulta meno completo sulle primitive MCP avanzate.

Valutazione MCP

| Ha una LICENSE | ✅ (MIT) |

|---|---|

| Almeno uno strumento | ✅ |

| Numero di Fork | 16 |

| Numero di Stars | 72 |

Valutazione: 7/10

Un server MCP solido e pratico per Replicate con strumenti robusti e setup chiaro, ma mancano alcune funzionalità MCP avanzate e documentazione su prompt/risorse.

Domande frequenti

- Cos'è il Server MCP di Replicate?

Il Server MCP di Replicate collega FlowHunt e l'API di Replicate, permettendo di cercare, esplorare ed eseguire predizioni su migliaia di modelli AI direttamente dai flussi di lavoro automatizzati.

- Quali strumenti fornisce il Server MCP di Replicate?

Offre ricerca semantica dei modelli, esplorazione, recupero dettagliato delle informazioni, esecuzione di predizioni e strumenti per la gestione delle collezioni—rendendo facile sperimentare e distribuire modelli AI.

- Come posso proteggere le mie chiavi API?

Utilizza sempre variabili d'ambiente (come mostrato negli esempi di configurazione) per salvare il token API di Replicate. Evita di inserire dati sensibili in file pubblici.

- Quali sono gli utilizzi comuni per questa integrazione?

Gli utilizzi tipici includono la scoperta rapida di modelli, l'esecuzione di predizioni AI (come generazione di immagini o testi), il recupero di dettagli sui modelli e l'automazione di flussi che sfruttano l'hub di modelli di Replicate.

- Il Server MCP di Replicate supporta template di prompt o risorse personalizzate?

No, la documentazione e il codice attuali non menzionano template di prompt o risorse MCP personalizzate. L'attenzione è focalizzata sugli strumenti per l'accesso ai modelli e le predizioni.

Connettiti con Replicate MCP in FlowHunt

Potenzia i tuoi flussi di sviluppo integrando i potenti modelli AI di Replicate con FlowHunt. Configura in pochi minuti e sblocca funzionalità avanzate di machine learning per i tuoi progetti.