Requisiti delle GPU per i Large Language Models

Scopri i requisiti essenziali delle GPU per i Large Language Models (LLM), incluse le differenze tra training e inferenza, le specifiche hardware e come sceglie...

Scopri i requisiti essenziali delle GPU per i Large Language Models (LLM), incluse le differenze tra training e inferenza, le specifiche hardware e come sceglie...

Esplora i migliori modelli linguistici di grandi dimensioni (LLM) per la programmazione a giugno 2025. Questa guida educativa completa offre approfondimenti, co...

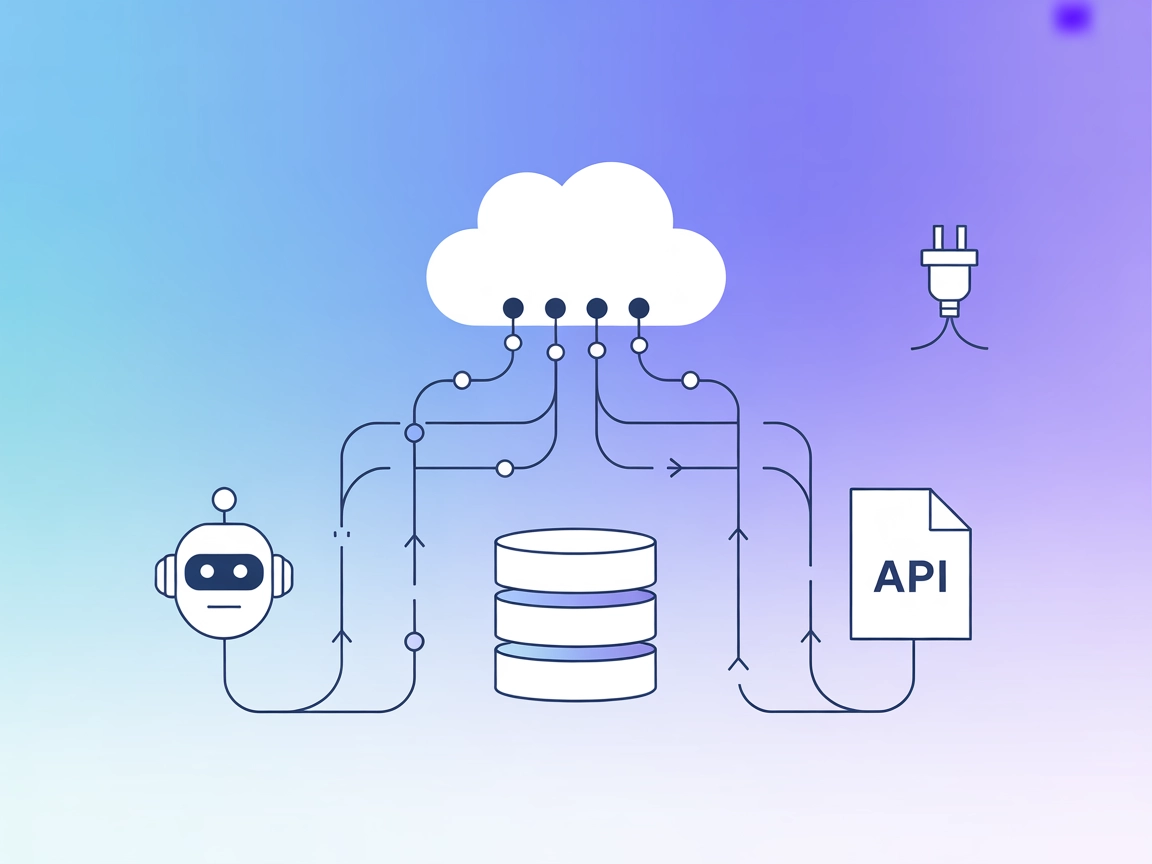

Eunomia MCP Server è un'estensione del framework Eunomia che orchestra le policy di data governance—come il rilevamento di PII e il controllo degli accessi—su f...

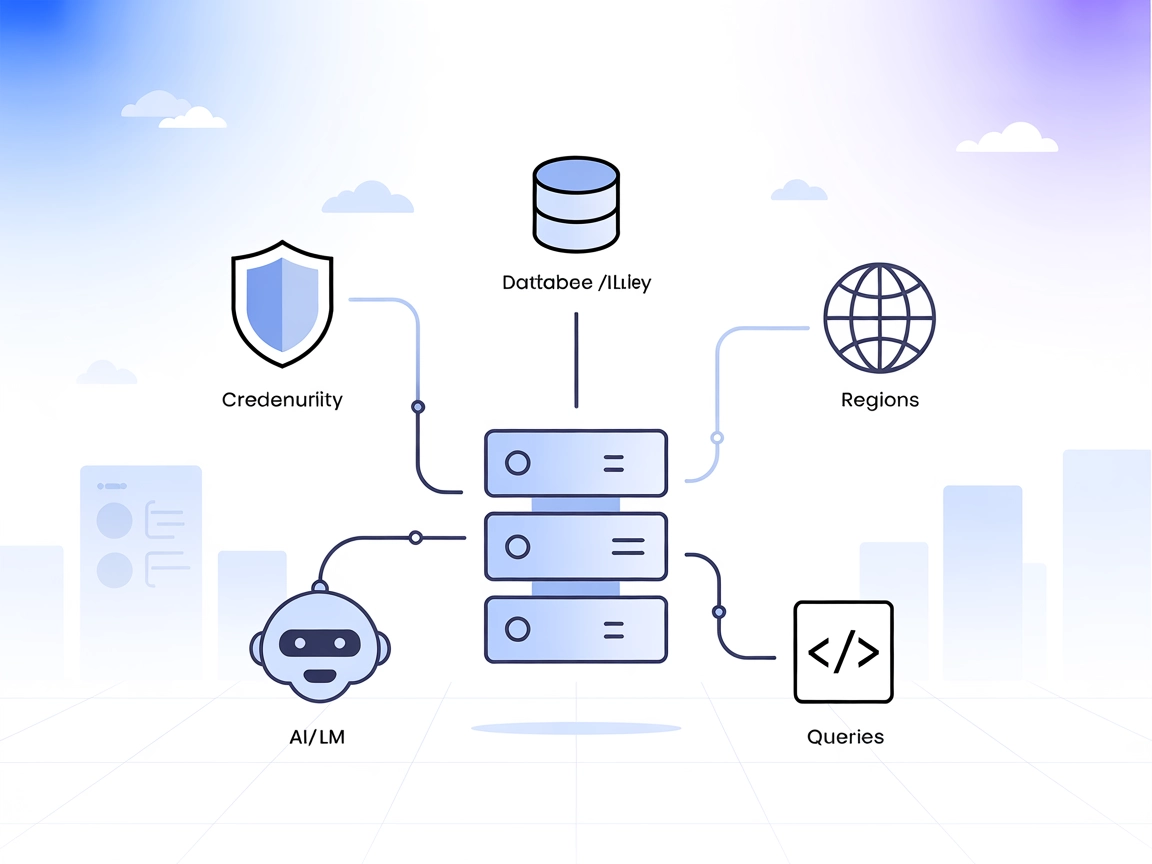

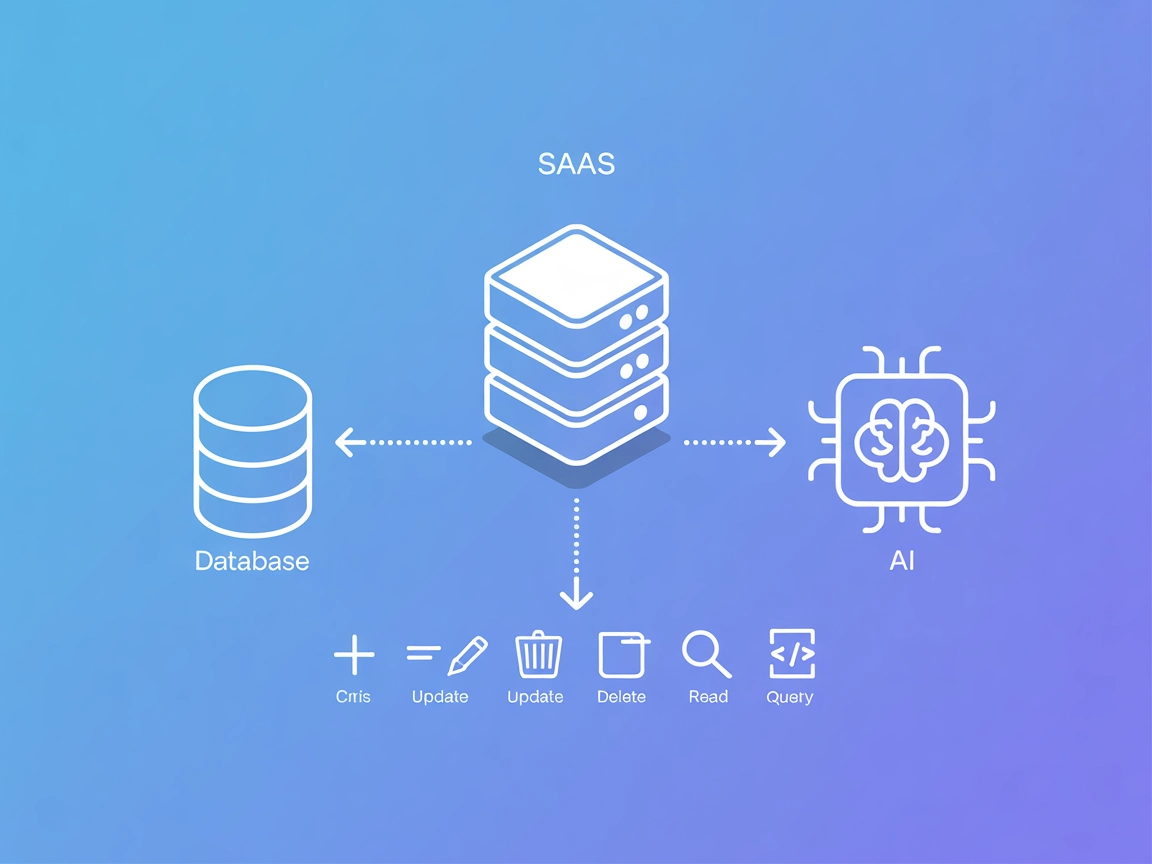

Il Server Nile MCP collega gli assistenti AI con la piattaforma di database Nile, consentendo l'automazione senza soluzione di continuità delle operazioni di da...

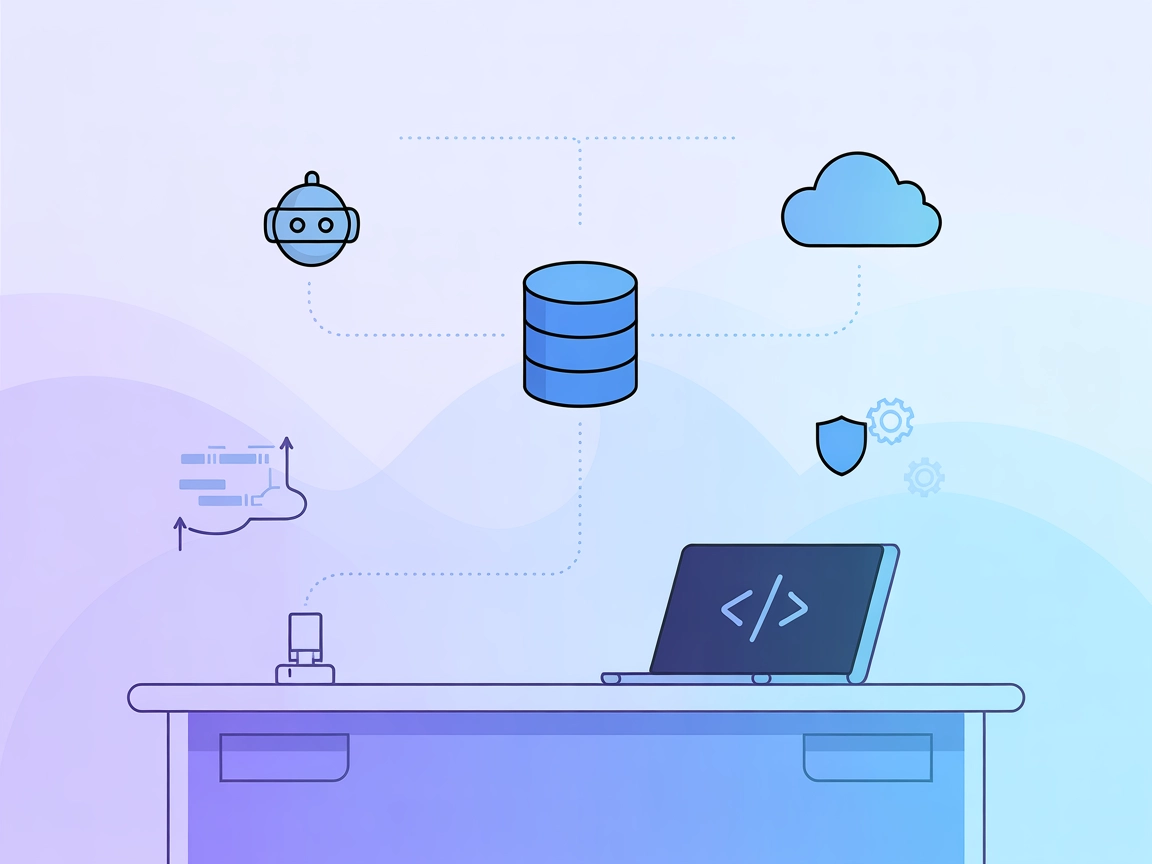

Il Server MCP MongoDB consente un'integrazione senza soluzione di continuità tra assistenti AI e database MongoDB, permettendo la gestione diretta del database,...

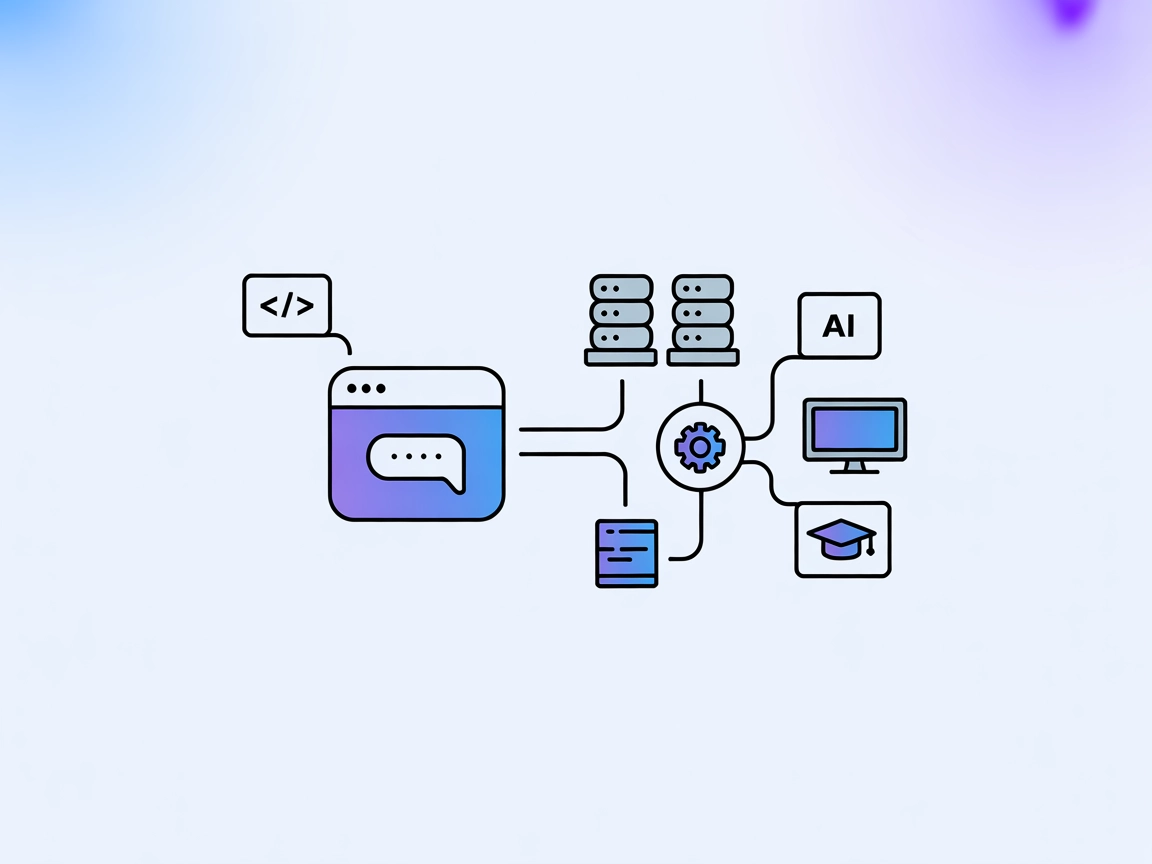

DocsMCP è un server Model Context Protocol (MCP) che offre ai Large Language Model (LLM) l'accesso in tempo reale a fonti di documentazione locali e remote, mig...

Il server MCP nx-mcp collega gli strumenti di build Nx monorepo con assistenti AI e flussi di lavoro LLM tramite il Model Context Protocol. Automatizza la gesti...

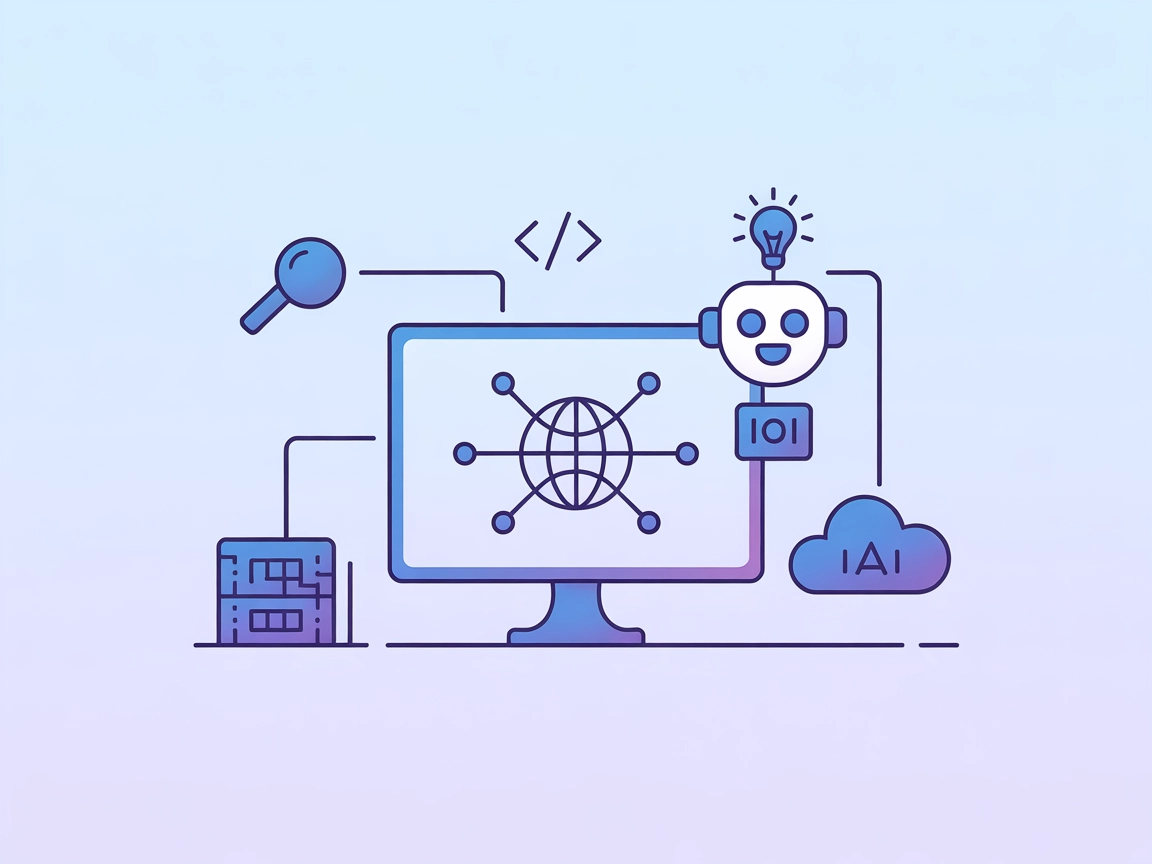

Il server MCP mcp-local-rag consente una ricerca web RAG (Retrieval-Augmented Generation) locale e rispettosa della privacy per LLM. Permette agli assistenti AI...

Il Serper MCP Server collega gli assistenti AI con la Ricerca Google tramite l’API Serper, abilitando funzionalità di ricerca in tempo reale su web, immagini, v...

Il Server MCP Astra DB fa da ponte tra i Large Language Model (LLM) e Astra DB, consentendo interrogazioni e gestione dei dati sicure e automatizzate. Permette ...

Il Server MCP Linear collega la piattaforma di project management di Linear con assistenti AI e LLM, consentendo ai team di automatizzare la gestione delle issu...

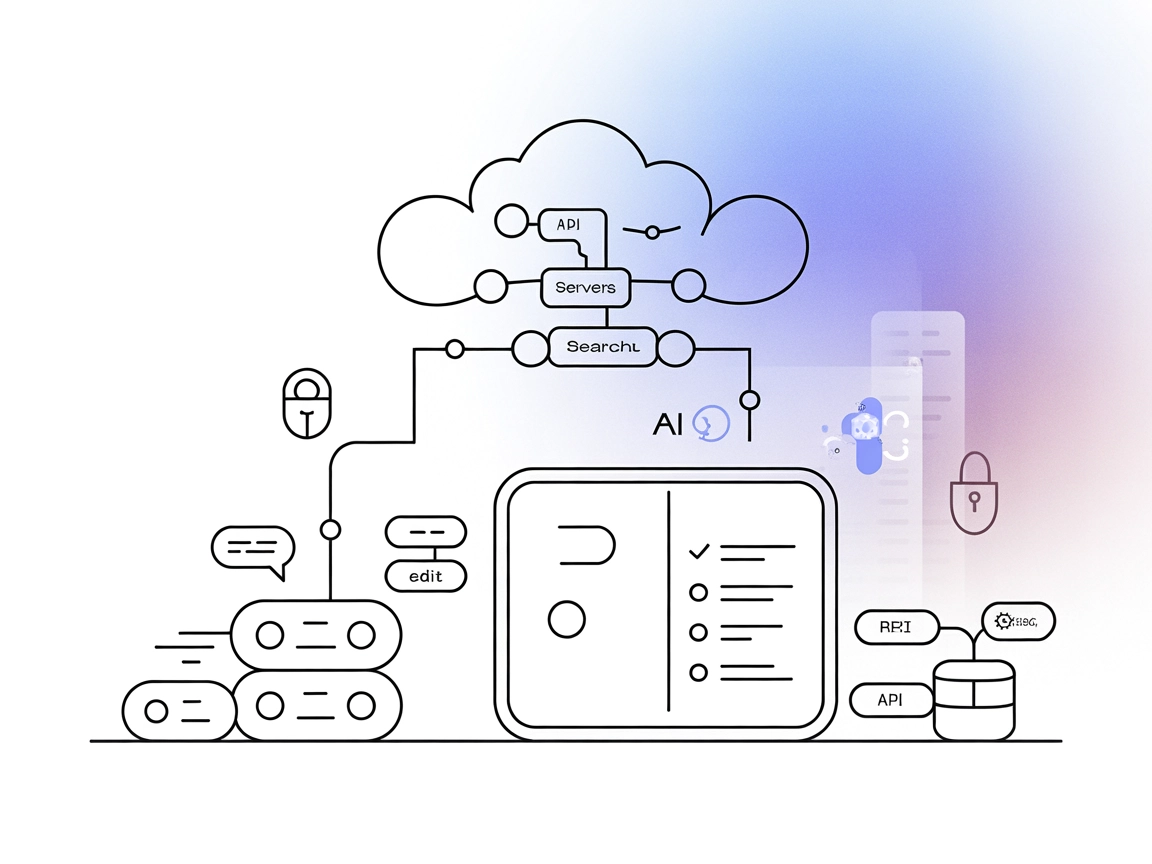

Il Server MCP LlamaCloud collega assistenti AI a molteplici indici gestiti su LlamaCloud, abilitando il recupero di documenti su scala enterprise, la ricerca e ...

Home Assistant MCP Server (hass-mcp) collega gli assistenti AI con il tuo smart home Home Assistant, consentendo agli LLM di interrogare, controllare e riassume...

Il server MCP any-chat-completions-mcp collega FlowHunt e altri strumenti a qualsiasi API Chat Completion compatibile con l'SDK OpenAI. Consente l'integrazione ...

Il Browserbase MCP Server consente un'automazione sicura del browser in cloud per l'IA e i LLM, permettendo un'interazione web avanzata, estrazione dati, test U...

Chat MCP è un'applicazione desktop di chat multipiattaforma che sfrutta il Model Context Protocol (MCP) per interfacciarsi con diversi Large Language Models (LL...

Il Couchbase MCP Server collega agenti AI e LLM direttamente ai cluster Couchbase, consentendo operazioni di database in linguaggio naturale, gestione automatiz...

Il Firecrawl MCP Server potenzia FlowHunt e gli assistenti AI con avanzate funzionalità di web scraping, ricerca approfondita e scoperta di contenuti. L’integra...

Il server QGIS MCP collega QGIS Desktop con LLM per l'automazione guidata dall'IA—consentendo il controllo di progetti, layer e algoritmi, oltre all'esecuzione ...

Il server YDB MCP collega assistenti AI e LLM ai database YDB, abilitando l’accesso, l’interrogazione e la gestione delle istanze YDB tramite linguaggio natural...

Il Microsoft Fabric MCP Server consente un'interazione fluida basata su AI con l'ecosistema di ingegneria dei dati e analytics di Microsoft Fabric. Supporta la ...

Il Patronus MCP Server semplifica la valutazione e la sperimentazione degli LLM per sviluppatori e ricercatori, offrendo automazione, elaborazione in batch e un...

Il Server MCP Schema OpenAPI espone specifiche OpenAPI ai Large Language Models, consentendo l’esplorazione delle API, la ricerca negli schemi, la generazione d...

Integra il server Vectorize MCP con FlowHunt per abilitare il recupero avanzato di vettori, la ricerca semantica e l'estrazione di testo per workflow AI potenti...

Il Mesh Agent MCP Server collega assistenti AI a fonti di dati esterne, API e servizi, facendo da ponte tra i large language model (LLM) e informazioni reali pe...

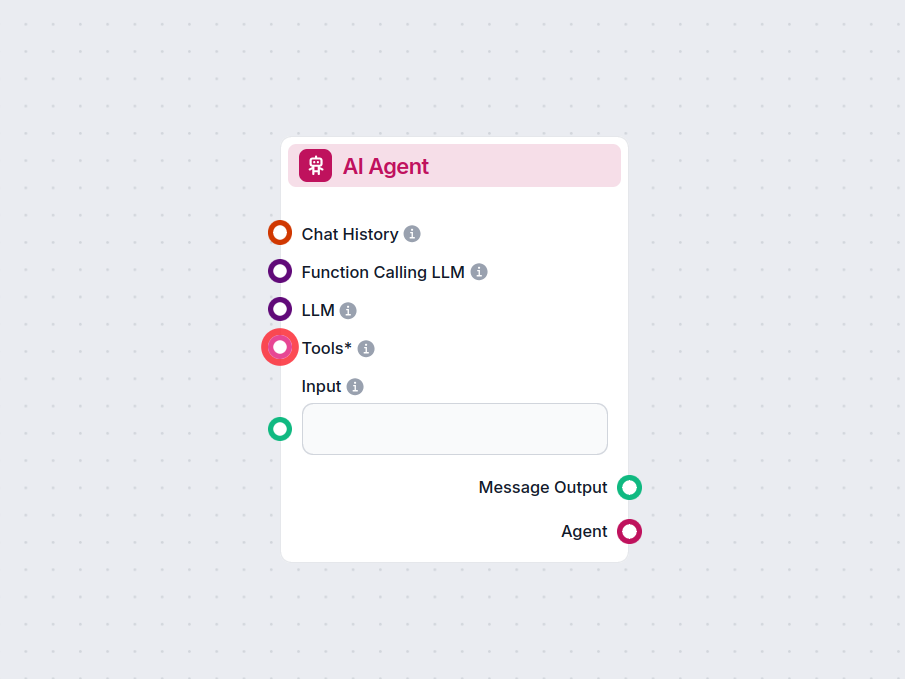

Il componente Agente AI in FlowHunt potenzia i tuoi workflow con capacità decisionali autonome e l'uso di strumenti integrati. Sfrutta grandi modelli linguistic...

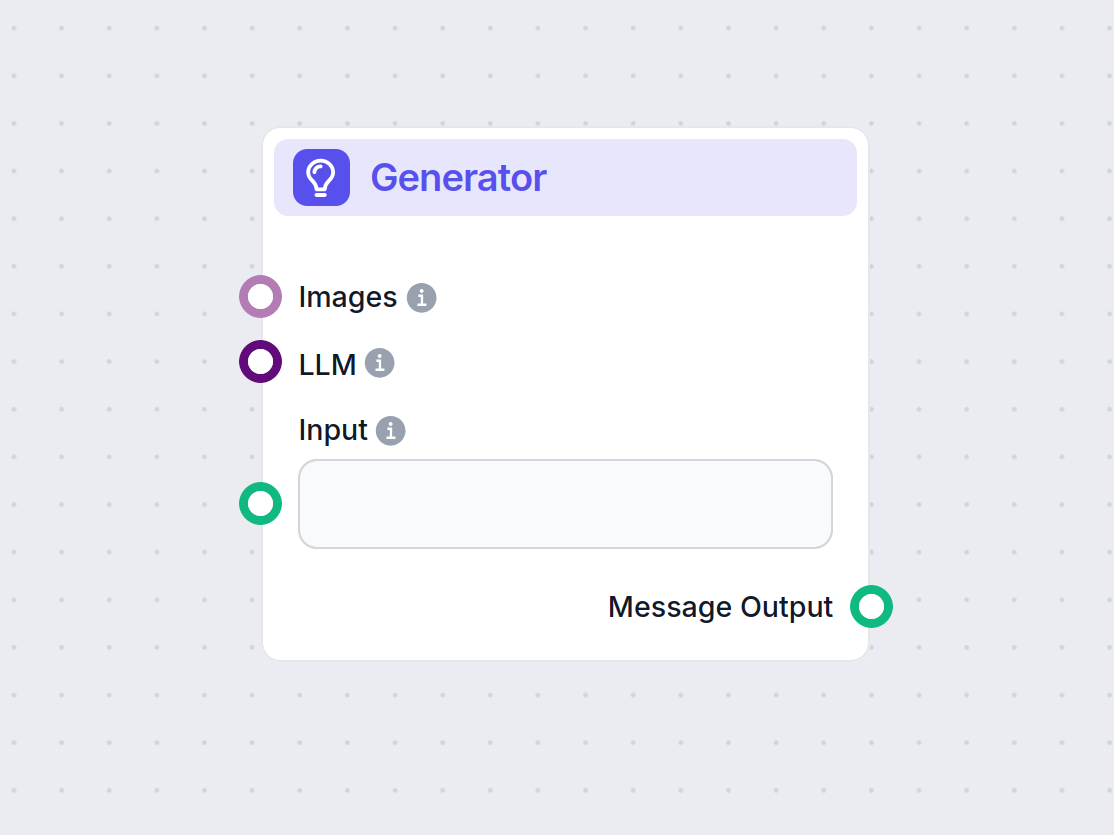

Esplora il componente Generatore in FlowHunt: potente generazione di testo guidata dall'IA utilizzando il modello LLM che preferisci. Crea facilmente risposte d...

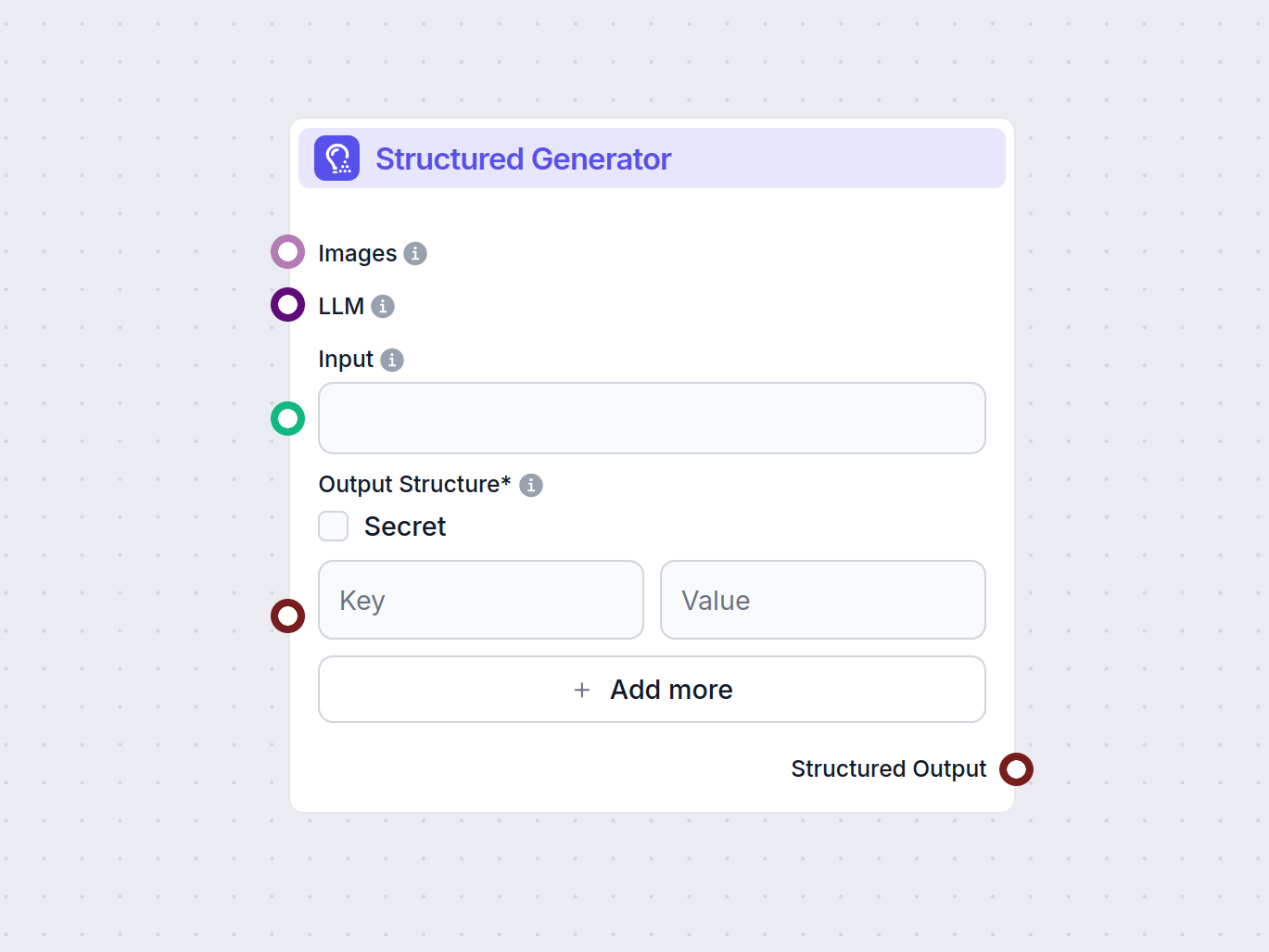

Il componente Generatore di Output Strutturato ti permette di creare dati precisi e strutturati da qualsiasi prompt di input utilizzando il modello LLM che pref...

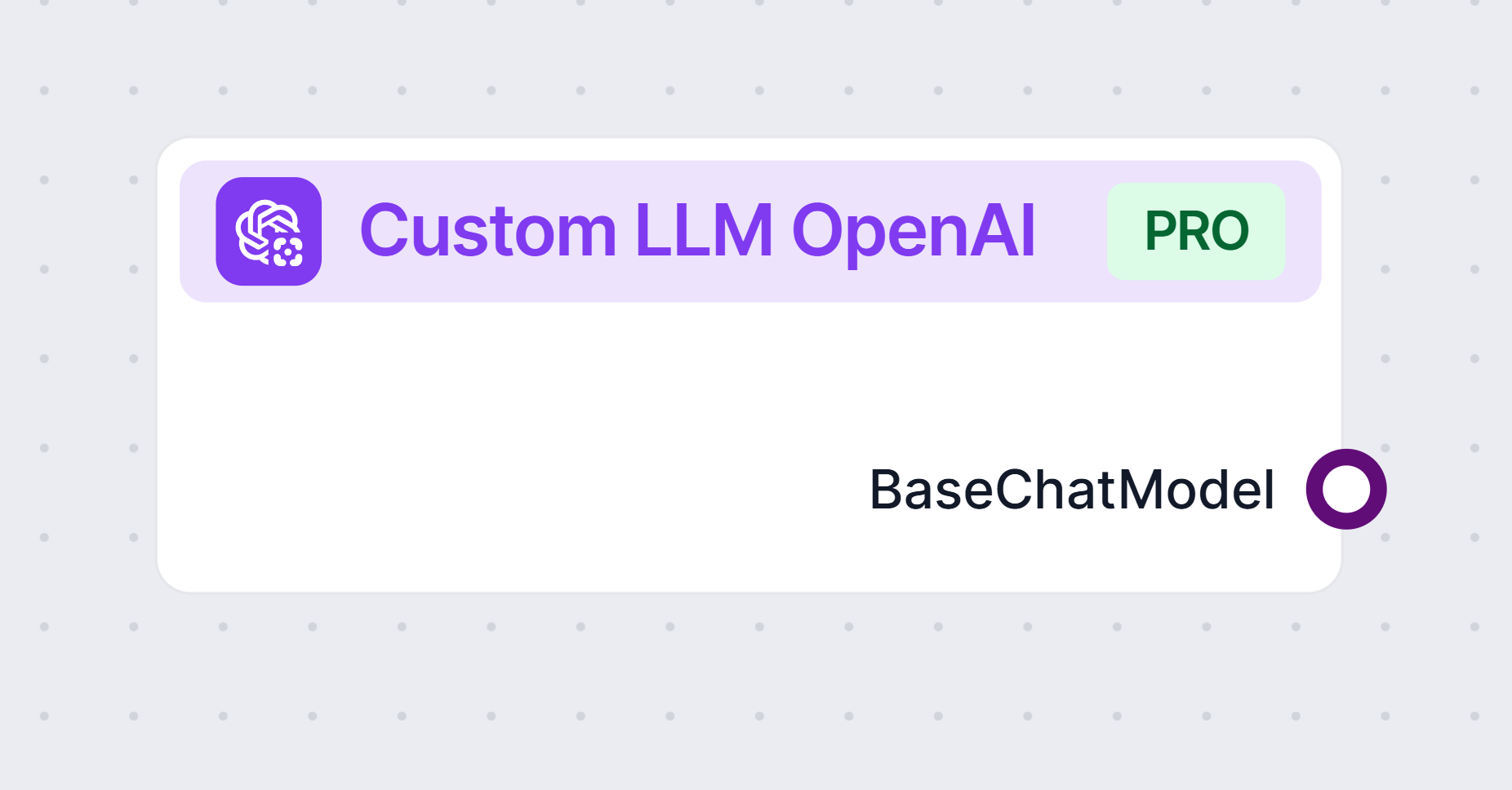

Sblocca la potenza dei modelli linguistici personalizzati con il componente Custom OpenAI LLM in FlowHunt. Integra senza problemi i tuoi modelli compatibili con...

Esplora i processi di pensiero degli Agenti AI in questa valutazione approfondita di GPT-4o. Scopri come si comporta in compiti come generazione di contenuti, p...

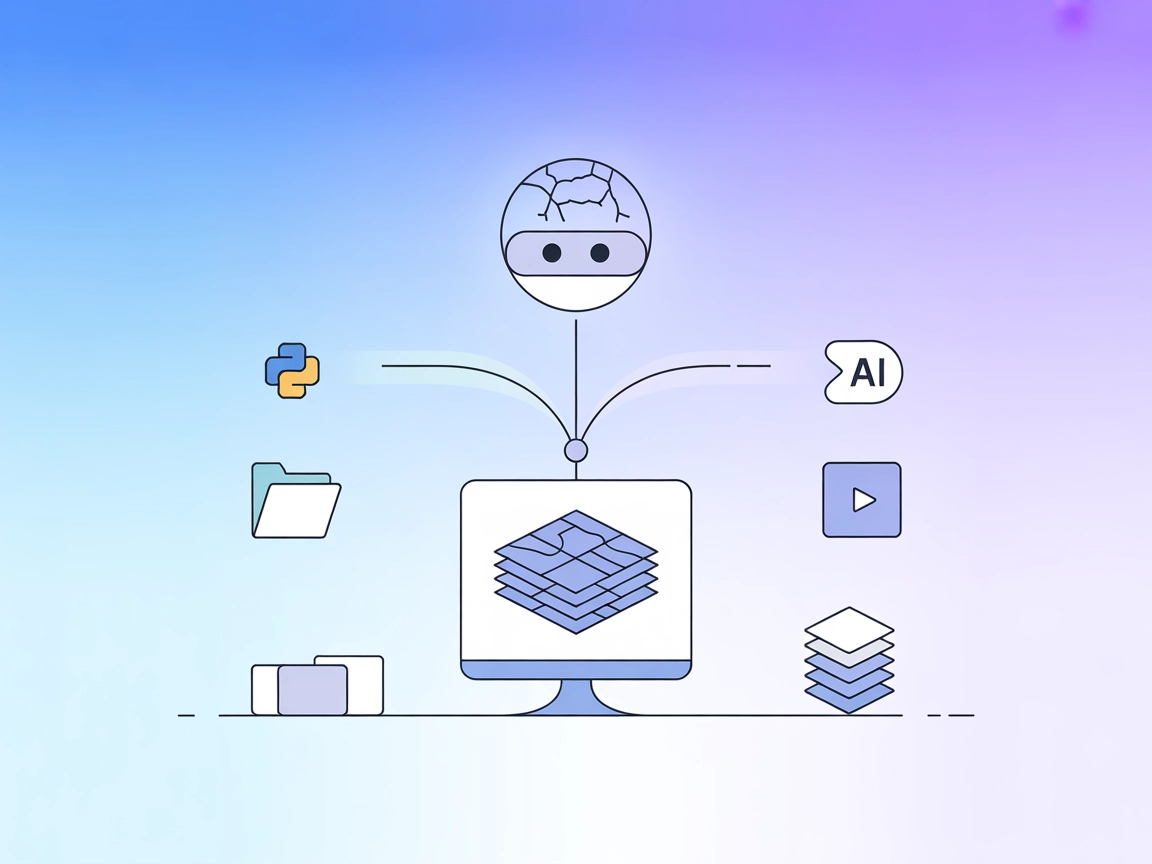

Agentic RAG (Agentic Retrieval-Augmented Generation) è un avanzato framework di intelligenza artificiale che integra agenti intelligenti nei sistemi RAG tradizi...

Cache Augmented Generation (CAG) è un approccio innovativo per migliorare i large language model (LLM) caricando preventivamente la conoscenza come cache di cop...

Scopri di più su Claude di Anthropic. Comprendi a cosa serve, i diversi modelli offerti e le sue caratteristiche uniche.

Scopri i costi associati all’addestramento e al deployment dei Large Language Models (LLM) come GPT-3 e GPT-4, inclusi i costi computazionali, energetici e hard...

Scopri come costruire un generatore di giochi JavaScript AI in FlowHunt utilizzando il Tool Calling Agent, il nodo Prompt e LLM Anthropic. Guida passo dopo pass...

Esplora le capacità avanzate di Llama 3.3 70B Versatile 128k come Agente AI. Questa recensione approfondita esamina il suo ragionamento, le capacità di problem-...

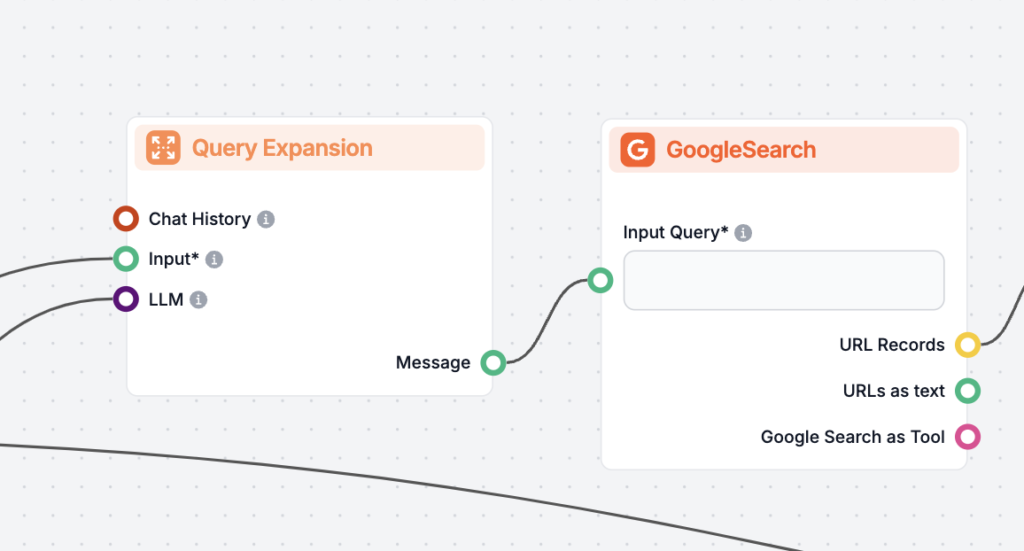

L'Espansione delle Query è il processo di arricchimento della query originale di un utente aggiungendo termini o contesto, migliorando il recupero dei documenti...

FlowHunt 2.4.1 introduce importanti nuovi modelli di IA, tra cui Claude, Grok, Llama, Mistral, DALL-E 3 e Stable Diffusion, ampliando le possibilità di sperimen...

La generazione di testo con i Large Language Models (LLM) si riferisce all'uso avanzato di modelli di machine learning per produrre testo simile a quello umano ...

Scopri di più sul modello Grok di xAI, un avanzato chatbot AI guidato da Elon Musk. Esplora il suo accesso ai dati in tempo reale, le caratteristiche principali...

Scopri come i ricercatori del MIT stanno facendo progredire i grandi modelli linguistici (LLM) con nuove intuizioni sulle credenze umane, innovativi strumenti p...

L'IA sta rivoluzionando l'intrattenimento, migliorando giochi, film e musica attraverso interazioni dinamiche, personalizzazione ed evoluzione in tempo reale de...

L'istruzione tuning è una tecnica nell'IA che affina i grandi modelli linguistici (LLM) su coppie istruzione-risposta, migliorando la loro capacità di seguire i...

Scopri come costruire agenti AI robusti e pronti per la produzione con la nostra metodologia completa dei 12 fattori. Scopri le migliori pratiche per l'elaboraz...

LangChain è un framework open-source per lo sviluppo di applicazioni alimentate da Large Language Models (LLM), che semplifica l'integrazione di potenti LLM com...

LangGraph è una libreria avanzata per la creazione di applicazioni stateful e multi-attore utilizzando Large Language Models (LLM). Sviluppata da LangChain Inc,...

FlowHunt supporta dozzine di modelli AI, inclusi i modelli Claude di Anthropic. Scopri come usare Claude nei tuoi strumenti AI e chatbot con impostazioni person...

FlowHunt supporta dozzine di modelli AI, inclusi i rivoluzionari modelli DeepSeek. Ecco come utilizzare DeepSeek nei tuoi strumenti AI e chatbot.

FlowHunt supporta dozzine di modelli AI, inclusi Google Gemini. Scopri come usare Gemini nei tuoi strumenti AI e chatbot, passa da un modello all'altro e contro...

FlowHunt supporta dozzine di modelli di generazione di testo, inclusi i modelli Llama di Meta. Scopri come integrare Llama nei tuoi strumenti e chatbot AI, pers...

FlowHunt supporta dozzine di modelli AI di testo, inclusi i modelli di Mistral. Ecco come utilizzare Mistral nei tuoi strumenti AI e chatbot.

FlowHunt supporta dozzine di modelli di generazione di testo, inclusi i modelli di OpenAI. Ecco come utilizzare ChatGPT nei tuoi strumenti di IA e chatbot.

FlowHunt supporta dozzine di modelli di generazione del testo, inclusi i modelli di xAI. Ecco come utilizzare i modelli xAI nei tuoi strumenti e chatbot AI.

Scopri come FlowHunt ha utilizzato il one-shot prompting per insegnare agli LLM a trovare e incorporare video YouTube rilevanti in WordPress. Questa tecnica gar...

Perplexity AI è un motore di ricerca avanzato basato sull'intelligenza artificiale e uno strumento conversazionale che sfrutta NLP e machine learning per fornir...

Nel campo dei LLM, un prompt è un testo di input che guida l’output del modello. Scopri come prompt efficaci, compresi zero-, one-, few-shot e chain-of-thought,...

Riduci le allucinazioni dell’AI e garantisci risposte accurate del chatbot utilizzando la funzione Pianificazione di FlowHunt. Scopri i vantaggi, casi d’uso pra...

La Risposta alle Domande con la Retrieval-Augmented Generation (RAG) combina il recupero delle informazioni e la generazione di linguaggio naturale per potenzia...

Un token, nel contesto dei grandi modelli linguistici (LLM), è una sequenza di caratteri che il modello converte in rappresentazioni numeriche per un'elaborazio...