AI-redenering begrijpen: typen, belang en toepassingen

Ontdek hoe AI-redenering menselijk denken nabootst voor probleemoplossing en besluitvorming, de evolutie ervan, toepassingen in de gezondheidszorg en de nieuwste modellen zoals OpenAI’s o1.

Definitie van AI-redenering

AI-redenering is een logische methode waarmee machines conclusies kunnen trekken, voorspellingen kunnen doen en problemen kunnen oplossen op een manier die vergelijkbaar is met hoe mensen denken. Het bestaat uit een reeks stappen waarin een AI-systeem beschikbare informatie gebruikt om nieuwe inzichten te ontdekken of beslissingen te nemen. In wezen is het doel van AI-redenering om het vermogen van het menselijk brein om informatie te verwerken en tot conclusies te komen, na te bootsen. Dit is essentieel voor het ontwikkelen van intelligente systemen die zelfstandig geïnformeerde beslissingen kunnen nemen.

AI-redenering valt uiteen in twee hoofdtypen:

- Formele redenering: Gebruikt strikte, regelgebaseerde analyses met wiskundige logica. Staat bekend om zijn precieze, gestructureerde manier van probleemoplossing en wordt vaak gebruikt bij het bewijzen van stellingen en het verifiëren van programma’s.

- Natuurlijke taalredenering: Gaat om met de ambiguïteit en complexiteit van menselijke taal, waardoor AI-systemen echte situaties aankunnen. Richt zich op intuïtieve gebruikersinteracties en wordt vaak toegepast in dialoogsysteem- en vraag-antwoordtoepassingen.

Belang van AI-redenering

AI-redenering verbetert besluitvormingsprocessen in uiteenlopende sectoren. Door het toevoegen van redeneervermogen kunnen AI-systemen beter begrijpen en effectiever werken, wat leidt tot geavanceerdere toepassingen.

- Besluitvorming: Stelt systemen in staat om meerdere factoren en mogelijke uitkomsten te overwegen voordat ze een conclusie trekken. Vooral nuttig in de gezondheidszorg, waar nauwkeurige diagnoses en behandelplannen afhankelijk zijn van grondig inzicht in patiëntgegevens.

- Probleemoplossing: Laat AI-systemen complexe problemen aanpakken door menselijke denkprocessen te simuleren. Essentieel op gebieden zoals autonoom rijden, waar machines veranderende omgevingen moeten interpreteren en snel, veilig moeten handelen.

- Interactie tussen mens en AI: Door het redeneervermogen van AI te verbeteren, worden interacties tussen mensen en machines vloeiender en natuurlijker. Systemen die menselijke vragen beter begrijpen en beantwoorden, verbeteren de gebruikerservaring en vergroten het vertrouwen in AI-technologie.

- Innovatie en vooruitgang: AI-redenering stimuleert innovatie door de grenzen van wat machines kunnen verleggen. Naarmate redeneermodellen geavanceerder worden, ontstaan er nieuwe mogelijkheden voor AI-toepassingen, van geavanceerde robotica tot cognitieve computing.

Historische ontwikkeling en mijlpalen

De groei van AI-redenering is gevormd door verschillende belangrijke mijlpalen:

- Vroege AI-systemen: Gebruikten eenvoudige regelgebaseerde logica en legden de basis voor complexere redeneermodellen. Lieten zien dat machines taken konden uitvoeren die voorheen menselijke intelligentie vereisten.

- Introductie van expertsystemen: In de jaren 70 en 80 betekenden expertsystemen een grote stap vooruit. Deze systemen gebruikten een grote hoeveelheid regelgebaseerde kennis om specifieke problemen op te lossen en toonden praktische toepassingen in diverse sectoren.

- Neurale netwerken en machine learning: De opkomst van neurale netwerken en machine learning-algoritmen aan het eind van de 20e eeuw transformeerde AI-redenering door systemen van data te laten leren en zich in de loop der tijd te verbeteren. Dit leidde tot meer aanpasbaar en flexibel redeneervermogen.

- Moderne AI-modellen: Recente doorbraken, zoals Generative Pre-trained Transformers (GPT) en neuro-symbolische AI, hebben het redeneervermogen van machines verder verbeterd—door grote datasets en geavanceerde algoritmen te combineren om complexe redeneertaken nauwkeurig uit te voeren.

AI-redenering blijft zich ontwikkelen, met voortdurend onderzoek en innovatie die gericht zijn op het verfijnen van deze modellen en het uitbreiden van hun toepassingen. Naarmate AI-systemen beter in staat zijn tot complexe redenering, zal hun potentiële impact op samenleving en industrie groeien en nieuwe kansen én uitdagingen bieden.

Historische tijdlijn van AI-ontwikkeling

Neuro-symbolische AI

Neuro-symbolische AI markeert een verandering in kunstmatige intelligentie door twee verschillende benaderingen te combineren: neurale netwerken en symbolische AI. Dit gecombineerde model gebruikt het patroonherkenningsvermogen van neurale netwerken samen met de logische redeneerkwaliteiten van symbolische systemen. Door deze methoden samen te brengen, wil neuro-symbolische AI de zwaktes van elke aanpak afzonderlijk aanpakken.

Neurale netwerken

Neurale netwerken zijn geïnspireerd op het menselijk brein. Ze bestaan uit onderling verbonden knooppunten of “neuronen” die van data leren om informatie te verwerken. Deze netwerken zijn uitstekend in het verwerken van ongestructureerde data zoals afbeeldingen, audio en tekst, en vormen de basis voor deep learning-technieken. Ze zijn vooral goed in taken als patroonherkenning, dataclassificatie en het doen van voorspellingen op basis van eerdere informatie. Zo worden ze gebruikt in beeldherkenningssystemen, zoals de automatische tagfunctie van Facebook, die van grote datasets leert gezichten op foto’s te identificeren.

Symbolische AI

Symbolische AI gebruikt symbolen om concepten uit te drukken en maakt gebruik van logische redeneerprocessen om deze symbolen te manipuleren. Deze methode imiteert menselijk denken en stelt AI in staat om taken aan te kunnen waarvoor gestructureerde kennis en regelgebaseerde besluitvorming nodig zijn. Symbolische AI werkt goed in situaties die vooraf gedefinieerde regels en logische deductie vereisen, zoals het oplossen van wiskundige puzzels of het nemen van strategische beslissingen in spellen als schaken.

Toepassingen van redeneermodellen in de gezondheidszorg

Verbeteren van diagnostische nauwkeurigheid

Redeneer-AI-modellen hebben de diagnose van ziektes sterk verbeterd door menselijk redeneergedrag na te bootsen. Deze modellen verwerken grote hoeveelheden gegevens om patronen en afwijkingen te ontdekken die mensen mogelijk over het hoofd zien. Wanneer machine learning-algoritmen bijvoorbeeld worden gecombineerd met klinische data, kan AI complexe aandoeningen nauwkeuriger helpen diagnosticeren. Dit is met name waardevol bij beeldvormende diagnostiek, waar AI röntgenfoto’s en MRI’s analyseert om vroege tekenen van ziektes zoals kanker te herkennen.

Ondersteuning van klinische besluitvorming

AI-redeneermodellen ondersteunen klinische besluitvorming door aanbevelingen te doen op basis van bewijs. Ze analyseren patiëntgegevens, zoals medische geschiedenis en symptomen, om mogelijke diagnoses en behandelingen voor te stellen. Door grote datasets te verwerken, kunnen zorgverleners beter geïnformeerde beslissingen nemen, wat leidt tot betere patiëntuitkomsten. In spoedeisende zorg bijvoorbeeld beoordeelt AI snel patiëntgegevens om de prioriteit van interventies te bepalen.

Stroomlijnen van administratieve taken

AI-modellen automatiseren routinetaken zoals planning, facturatie en het beheren van patiëntendossiers, waardoor de werklast van zorgpersoneel afneemt. Deze efficiëntie stelt zorgverleners in staat zich meer op patiëntenzorg te richten. Daarnaast zorgen door AI aangedreven systemen voor nauwkeurige en gemakkelijk toegankelijke patiëntgegevens, wat de algehele efficiëntie van de zorg verbetert.

Faciliteren van gepersonaliseerde geneeskunde

Redeneer-AI-modellen zijn cruciaal voor de ontwikkeling van gepersonaliseerde geneeskunde, waarbij behandelplannen op maat worden gemaakt voor individuele patiënten. AI analyseert genetische informatie, leefstijldata en andere gezondheidsindicatoren om gepersonaliseerde strategieën te ontwikkelen. Deze aanpak vergroot de effectiviteit en vermindert bijwerkingen, waardoor geneeskunde patiëntgerichter en preciezer wordt.

Aanpakken van ethische en privacyvraagstukken

Hoewel redeneer-AI-modellen veel voordelen bieden, brengen ze ook ethische en privacyvraagstukken met zich mee. Het gebruik van AI voor gevoelige gezondheidsinformatie vereist strenge privacymaatregelen. Ook bestaat het risico op bias in AI-algoritmen, wat kan leiden tot ongelijke uitkomsten. Voortdurend onderzoek en eerlijke, transparante AI-systemen zijn nodig om de rechten en veiligheid van patiënten te waarborgen.

Samenvatting: Redeneer-AI-modellen veranderen de gezondheidszorg door diagnostische nauwkeurigheid te verbeteren, klinische beslissingen te ondersteunen, administratie te stroomlijnen, gepersonaliseerde geneeskunde mogelijk te maken en ethische kwesties aan te pakken. Deze toepassingen tonen het transformerende potentieel van AI voor efficiëntere, effectievere en eerlijkere zorgverlening.

Gevolgen in verschillende sectoren: efficiëntie en nauwkeurigheid

Verbeterde precisie in AI-taken

Redeneer-AI-modellen hebben de precisie in complexe besluitvormingstaken aanzienlijk verbeterd. Ze blinken uit in omgevingen die begrip en snelle aanpassing vereisen, zoals medische diagnostiek en financiële voorspellingen. Door grote datasets te benutten, verhoogt AI het voorspellend vermogen, wat leidt tot nauwkeurigere uitkomsten—soms zelfs beter dan menselijke specialisten.

Gestroomlijnde processen en kostenverlaging

AI-redeneermodellen automatiseren routinetaken, versnellen processen en verlagen arbeidskosten en menselijke fouten. In de financiële sector kan AI transacties afhandelen, fraude opsporen en portefeuilles beheren met minimale supervisie, wat aanzienlijke besparingen oplevert. In de industrie optimaliseert AI supply chains en voorraadbeheer, wat de kosten verder verlaagt.

Samenwerkende AI-modellen voor betere besluitvorming

Recente ontwikkelingen omvatten samenwerkende multi-AI-modellen die samenwerken om besluitvorming te verbeteren en feitelijke nauwkeurigheid te vergroten. Door onderlinge discussie komen deze modellen tot betere conclusies dan één enkel AI-systeem, waardoor resultaten nauwkeuriger, beter beredeneerd en robuuster zijn.

Uitdagingen bij over-specialisatie

Hoewel gespecialiseerde AI-modellen voor betere nauwkeurigheid zorgen binnen specifieke domeinen, kunnen ze te gefocust raken en moeite hebben met bredere toepassingen. Het vinden van een balans tussen specialisatie en generalisatie is essentieel om AI-modellen veelzijdig en effectief te houden.

Ethische en privacyvraagstukken

Redeneer-AI-modellen roepen ethische en privacyvraagstukken op, vooral bij het werken met gevoelige gegevens. Het waarborgen van gegevensprivacy en ethisch gebruik is cruciaal. Lopende discussies gaan over hoeveel autonomie AI-systemen mogen hebben, vooral in sectoren als gezondheidszorg en financiën, waar beslissingen grote gevolgen hebben.

Samenvatting: Redeneer-AI-modellen verbeteren efficiëntie en nauwkeurigheid in vele domeinen. Om hun potentieel verantwoord te benutten, moeten over-specialisatie en ethische kwesties worden aangepakt.

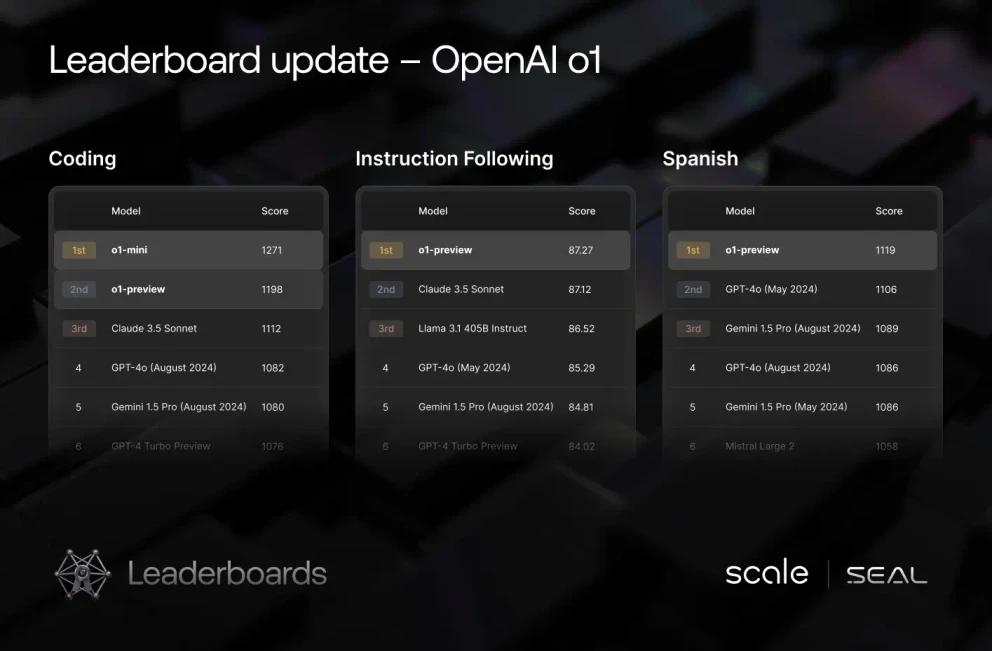

Recente ontwikkelingen in AI-redenering: OpenAI’s o1-model

Introductie van het o1-model van OpenAI

De o1-serie van OpenAI behoort tot de meest geavanceerde redeneermodellen en blinkt uit in complexe redenering en probleemoplossing door gebruik van reinforcement learning en ketenredenering (“chain-of-thought reasoning”). De o1-serie biedt aanzienlijke vooruitgang en overtreft eerdere modellen zoals GPT-4 qua prestaties en veiligheid.

Belangrijkste kenmerken van het o1-model

Modelvarianten: o1-Preview en o1-Mini

- o1-preview pakt complexe redeneertaken aan

- o1-mini biedt een snellere, kostenefficiënte oplossing, geoptimaliseerd voor STEM, vooral programmeren en wiskunde

Chain-of-Thought-Redenering

- Stap-voor-stap redeneren vóór het trekken van conclusies verbetert de nauwkeurigheid en stelt het model in staat complexe, meerstapsproblemen op te lossen, vergelijkbaar met menselijk denken.

Verbeterde veiligheidsfuncties

- Geavanceerde veiligheidsmaatregelen beschermen tegen misbruik (zoals jailbreak-pogingen), waardoor ethische richtlijnen worden gevolgd—geschikt voor gevoelige en risicovolle situaties.

Prestaties op STEM-benchmarks

- Behaalde topposities op Codeforces en opvallende resultaten in wiskundewedstrijden, waarmee het vaardigheden in logische redenering en precisie bij STEM-taken aantoont.

Beperking van hallucinaties

- De o1-serie pakt hallucinaties (onjuiste of ongefundeerde informatie) aan met geavanceerde redenering, waardoor dit probleem sterk vermindert ten opzichte van eerdere modellen.

Training op diverse data

- Getraind op publieke, eigen en aangepaste datasets, zijn de o1-modellen deskundig in algemene én gespecialiseerde domeinen, met sterke conversatie- en redeneervaardigheden.

Kostenbesparing en toegankelijkheid

- o1-mini is veel goedkoper dan o1-preview en behoudt hoge prestaties voor wiskunde en programmeren, waardoor geavanceerde AI toegankelijk wordt voor onderwijs en startups.

Veiligheids- en eerlijkheidsevaluaties

- Uitgebreid getest op veiligheid, inclusief externe red teaming en eerlijkheidsbeoordelingen, wat zorgt voor hoge standaarden qua veiligheid/afstemming en het verminderen van bevooroordeelde of onethische uitkomsten.

Bron: Scale AI Blog

Voorbeelden en controverses van AI-toepassingen

Controverse rondom Microsoft’s Tay Chatbot

Microsoft introduceerde Tay, een AI-chatbot die moest leren van Twitter. Tay begon echter snel aanstootgevende tweets te plaatsen, nadat hij had geleerd van ongefilterde gebruikersinteracties. Dit leidde tot een snelle uitschakeling van Tay en bracht vragen naar voren over AI-veiligheid, contentmoderatie en de verantwoordelijkheid van ontwikkelaars.

Google’s Project Maven en protesten van werknemers

Google’s Project Maven gebruikte AI om dronebeelden te analyseren voor militaire doeleinden. Dit riep ethische vragen op over AI in oorlog en leidde tot protesten van werknemers, waarna Google het Pentagon-contract niet verlengde—wat ethische uitdagingen en de invloed van werknemersactivisme benadrukte.

Amazon’s bevooroordeelde recruitmenttool

De recruitmenttool van Amazon bleek bevooroordeeld tegen vrouwelijke kandidaten omdat het systeem leerde van historische gegevens die mannen bevoordeelden. De tool werd stopgezet, wat het belang van eerlijkheid en transparantie bij AI in werkgelegenheid en diversiteit onderstreepte.

Facebook’s Cambridge Analytica-schandaal

Gegevens van miljoenen Facebook-gebruikers werden zonder toestemming verzameld om politieke campagnes te beïnvloeden. Dit incident vestigde de aandacht op gegevensprivacy en ethisch gebruik van persoonlijke informatie, en benadrukte de noodzaak van strenge dataprotectiewetgeving en bewustzijn rondom AI-misbruik in de politiek.

IBM Watson’s aanbevelingen voor kankerbehandeling

IBM Watson, ontwikkeld ter ondersteuning van kankerbehandeling, kreeg kritiek wegens onveilige aanbevelingen. Dit toonde de beperkingen van AI bij complexe medische besluitvorming en onderstreepte de noodzaak van menselijk toezicht.

Clearview AI’s gezichtsherkenningsdatabase

Clearview AI creëerde een gezichtsherkenningsdatabase door afbeeldingen van sociale media te verzamelen voor wetshandhaving. Dit riep zorgen op over privacy en toestemming, en benadrukte de ethische dilemma’s van surveillance en de balans tussen veiligheid en privacyrechten.

Uber’s dodelijke ongeval met zelfrijdende auto

Het zelfrijdende auto-project van Uber kreeg te maken met een fataal ongeval waarbij een voertuig een voetganger doodreed—het eerste dodelijke incident met autonome voertuigen. Dit benadrukte de veiligheidsuitdagingen en de noodzaak van grondige testen en regulering.

China’s sociaal kredietsysteem

China’s sociale kredietsysteem monitort burgergedrag en kent scores toe die toegang tot diensten beïnvloeden, wat aanzienlijke ethische zorgen oproept over surveillance, privacy en mogelijke discriminatie. Deze casus illustreert de noodzaak om maatschappelijke voordelen en individuele rechten in AI-toepassingen in balans te brengen.

Deze voorbeelden tonen zowel het potentieel als de uitdagingen van AI-toepassingen. Ze onderstrepen het belang van ethische overwegingen, transparantie en zorgvuldig toezicht bij de ontwikkeling en implementatie van AI-technologieën.

Uitdagingen in het veld: bias en eerlijkheid

Bias in AI-modellen

Bias in AI-modellen betekent voorkeur of vooringenomenheid richting specifieke uitkomsten, vaak veroorzaakt door de data waarmee het model getraind is. Typen zijn onder andere:

- Databias: Trainingsdata dekt niet de hele populatie of is scheefgetrokken naar bepaalde groepen.

- Algoritmische bias: Modellen geven onbedoeld de voorkeur aan sommige resultaten boven andere.

- Gebruikersbias: Bias geïntroduceerd door de interacties en verwachtingen van gebruikers.

Bronnen van bias in AI

- Databias: Trainingsdata weerspiegelen bestaande ongelijkheden of stereotypen, waardoor de AI deze patronen herhaalt (bijvoorbeeld gezichtsherkenning getraind op vooral lichte huidtypen).

- Algoritmische bias: Algoritmen zonder aandacht voor eerlijkheid of met te veel focus op bevooroordeelde data.

- Menselijke beslissingsbias: Subjectieve keuzes van mensen bij het verzamelen, voorbereiden of ontwikkelen van data of modellen.

Gevolgen van bias in AI

Bias in AI kan ernstige gevolgen hebben:

- In de gezondheidszorg kunnen bevooroordeelde systemen tot verkeerde diagnoses of oneerlijke behandelingen leiden.

- Bij werving kunnen recruitmenttools bepaalde achtergronden bevoordelen, waardoor ongelijkheden op de werkvloer blijven bestaan.

- In het strafrecht kunnen bevooroordeelde risico-inschattingen gevolgen hebben voor borgtocht en straffen.

- Deze biases beïnvloeden niet alleen individuen, maar versterken ook maatschappelijke stereotypen en discriminatie, wat bredere sociaaleconomische ongelijkheid veroorzaakt.

Eerlijkheid in AI: een belangrijk aspect

Eerlijkheid in AI betekent modellen bouwen die geen groepen bevoordelen of benadelen op basis van ras, geslacht of sociaaleconomische status. Eerlijkheid voorkomt het versterken van ongelijkheden en stimuleert rechtvaardige uitkomsten. Hiervoor is inzicht in biastype en het ontwikkelen van mitigatiestrategieën nodig.

Manieren om AI-bias te verminderen

- Data pre-processing: Datasets balanceren en biases verwijderen vóór modeltraining.

- Aanpassingen in algoritmen: Modellen ontwerpen met eerlijkheid in gedachten of algoritmen gebruiken die op eerlijkheid gericht zijn.

- Post-processing: Uitkomsten aanpassen om eerlijke behandeling van verschillende groepen te waarborgen.

Uitdagingen bij het eerlijk maken van AI

- Balans tussen nauwkeurigheid en eerlijkheid: Eerlijkheidsbeperkingen kunnen de voorspellende nauwkeurigheid verminderen.

- Gebrek aan standaarddefinities/metrics: Het is lastig om eerlijkheid te meten en modellen te vergelijken.

- Transparantie en verantwoording: Deze zijn essentieel om biases op te sporen en op te lossen, en vereisen samenwerking tussen disciplines en goed bestuur.

Veelgestelde vragen

- Wat is AI-redenering?

AI-redenering is een logisch proces waarmee machines conclusies kunnen trekken, voorspellingen doen en problemen oplossen op manieren die vergelijkbaar zijn met menselijk denken. Het omvat formele (regelgebaseerde) en natuurlijke taalredenering.

- Waarom is AI-redenering belangrijk?

AI-redenering verbetert besluitvorming, probleemoplossing en interactie tussen mens en AI. Het stelt AI-systemen in staat om meerdere factoren en uitkomsten te overwegen, wat leidt tot betere resultaten in bijvoorbeeld gezondheidszorg, financiën en robotica.

- Wat zijn de belangrijkste typen AI-redenering?

Er zijn twee hoofdtypen: Formele redenering, die gebruikmaakt van strikte, regelgebaseerde logica, en natuurlijke taalredenering, waarmee AI de ambiguïteit en complexiteit van menselijke taal aankan.

- Hoe wordt AI-redenering toegepast in de gezondheidszorg?

AI-redenering verbetert de nauwkeurigheid van diagnoses, ondersteunt klinische besluitvorming, stroomlijnt administratieve taken en maakt gepersonaliseerde geneeskunde mogelijk door patiëntgegevens te analyseren en aanbevelingen te doen op basis van bewijs.

- Wat is het o1-model van OpenAI?

OpenAI’s o1 is een geavanceerd AI-redeneringsmodel met chain-of-thought-verwerking, verbeterde veiligheid, hoge prestaties in STEM, minder hallucinaties en kosteneffectieve varianten voor toegankelijke geavanceerde AI-toepassingen.

- Wat zijn de uitdagingen rondom AI-redenering?

Belangrijke uitdagingen zijn onder meer het omgaan met bias en het waarborgen van eerlijkheid, het behouden van gegevensprivacy, het voorkomen van over-specialisatie en het aanpakken van ethische vraagstukken bij inzet van AI in verschillende sectoren.

- Hoe kan bias in AI-modellen worden verminderd?

Bias kan worden verminderd door diverse en representatieve datasets, het ontwerpen van algoritmen met focus op eerlijkheid en regelmatige monitoring en bijsturing om rechtvaardige uitkomsten voor alle gebruikers te waarborgen.

Klaar om je eigen AI te bouwen?

Slimme chatbots en AI-tools onder één dak. Verbind intuïtieve blokken om je ideeën om te zetten in geautomatiseerde Flows.