Cursor Talk To Figma MCP Server

Automatiseer, analyseer en wijzig Figma-bestanden programmatisch met de Cursor Talk To Figma MCP Server—maak ontwerpautomatisering toegankelijk voor AI-agenten en ontwikkelaars.

Wat doet de “Cursor Talk To Figma” MCP Server?

De Cursor Talk To Figma MCP Server vormt een brug tussen de Cursor AI-ontwikkelomgeving en Figma, waardoor naadloze interactie ontstaat tussen AI-assistenten en ontwerpbestanden. Door Figma’s ontwerpinformatie en acties beschikbaar te maken via het Model Context Protocol (MCP), stelt deze server ontwikkelaars en AI-agenten in staat om Figma-ontwerpen programmatisch te lezen, analyseren en wijzigen. Deze integratie stroomlijnt workflows voor ontwerpers en ontwikkelaars door repetitieve ontwerptaken te automatiseren, bulkvervanging van inhoud mogelijk te maken, component-overrides door te voeren en andere automatiseringsmogelijkheden direct vanuit AI-aangedreven tools te bieden. De server verhoogt de productiviteit en samenwerking door Figma’s mogelijkheden via gestandaardiseerde MCP-eindpunten toegankelijk te maken.

Lijst met prompts

Er worden geen prompt-sjablonen expliciet vermeld in de repository of documentatie.

Lijst met resources

Er is geen expliciete lijst van MCP-resources opgenomen in de repository of documentatie.

Lijst met tools

Er is geen expliciete lijst van MCP-tools opgenomen in de repository of serverbestanden zoals gepresenteerd.

Toepassingen van deze MCP Server

- Bulk tekstinhoud vervangen: Automatiseer het vervangen van tekstinhoud in meerdere Figma-ontwerpen, waardoor handmatige bewerkingen afnemen en ontwerpteams veel tijd besparen.

- Instance override-propagatie: Voer automatisch component-instance overrides door van één bron naar meerdere doelen, zodat repetitieve updates in grote ontwerp-systemen eenvoudiger worden.

- Ontwerpautomatisering: Maak AI-gestuurde automatisering van diverse Figma-taken mogelijk, zoals het updaten van stijlen, aanpassen van lay-outs of genereren van nieuwe ontwerpelementen, direct vanuit ontwikkelomgevingen.

- Figma integreren met AI-agenten: Geef AI-agenten in Cursor de mogelijkheid om Figma-bestanden te lezen en te schrijven, waardoor geavanceerde ontwerpanalyse, kritiek of snel prototypen mogelijk wordt.

- Samenwerkende ontwikkeling en ontwerp: Overbrug de kloof tussen ontwikkel- en ontwerpteams door programmatische toegang tot Figma-ontwerpen vanuit code, wat zorgt voor strakkere integratie en snellere feedbackloops.

Hoe stel je het in

Windsurf

- Zorg dat je Bun hebt geïnstalleerd (

curl -fsSL https://bun.sh/install | bash). - Clone de repository en voer

bun setupuit om afhankelijkheden te installeren. - Start de WebSocket-server:

bun socket. - Voeg de MCP-server toe aan je Windsurf-configuratie:

{ "mcpServers": { "cursor-talk-to-figma": { "command": "bunx", "args": ["cursor-talk-to-figma-mcp"] } } } - Sla de configuratie op en herstart Windsurf. Controleer de verbinding met de server.

API-sleutels beveiligen:

{

"mcpServers": {

"cursor-talk-to-figma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp"],

"env": {

"FIGMA_API_KEY": "${env.FIGMA_API_KEY}"

},

"inputs": {

"apiKey": "${env.FIGMA_API_KEY}"

}

}

}

}

Claude

- Installeer vereisten (Bun).

- Voer

bun setupenbun socketuit zoals hierboven. - Voeg de MCP-server toe aan je Claude-configuratiebestand:

{ "mcpServers": { "cursor-talk-to-figma": { "command": "bunx", "args": ["cursor-talk-to-figma-mcp"] } } } - Opslaan en Claude herstarten.

API-sleutels beveiligen: (zie voorbeeld hierboven)

Cursor

- Installeer Bun en voer

bun setupuit. - Start de WebSocket-server:

bun socket. - Voeg het volgende toe aan je Cursor-configuratie:

{ "mcpServers": { "cursor-talk-to-figma": { "command": "bunx", "args": ["cursor-talk-to-figma-mcp"] } } } - Opslaan en Cursor herstarten; controleer vervolgens of de MCP-server actief is.

API-sleutels beveiligen: (zie voorbeeld hierboven)

Cline

- Zorg dat Bun is geïnstalleerd.

- Voer

bun setupenbun socketuit. - Voeg in je Cline-configuratie toe:

{ "mcpServers": { "cursor-talk-to-figma": { "command": "bunx", "args": ["cursor-talk-to-figma-mcp"] } } } - Opslaan, Cline herstarten en verifiëren.

API-sleutels beveiligen: (zie voorbeeld hierboven)

Hoe gebruik je deze MCP binnen flows

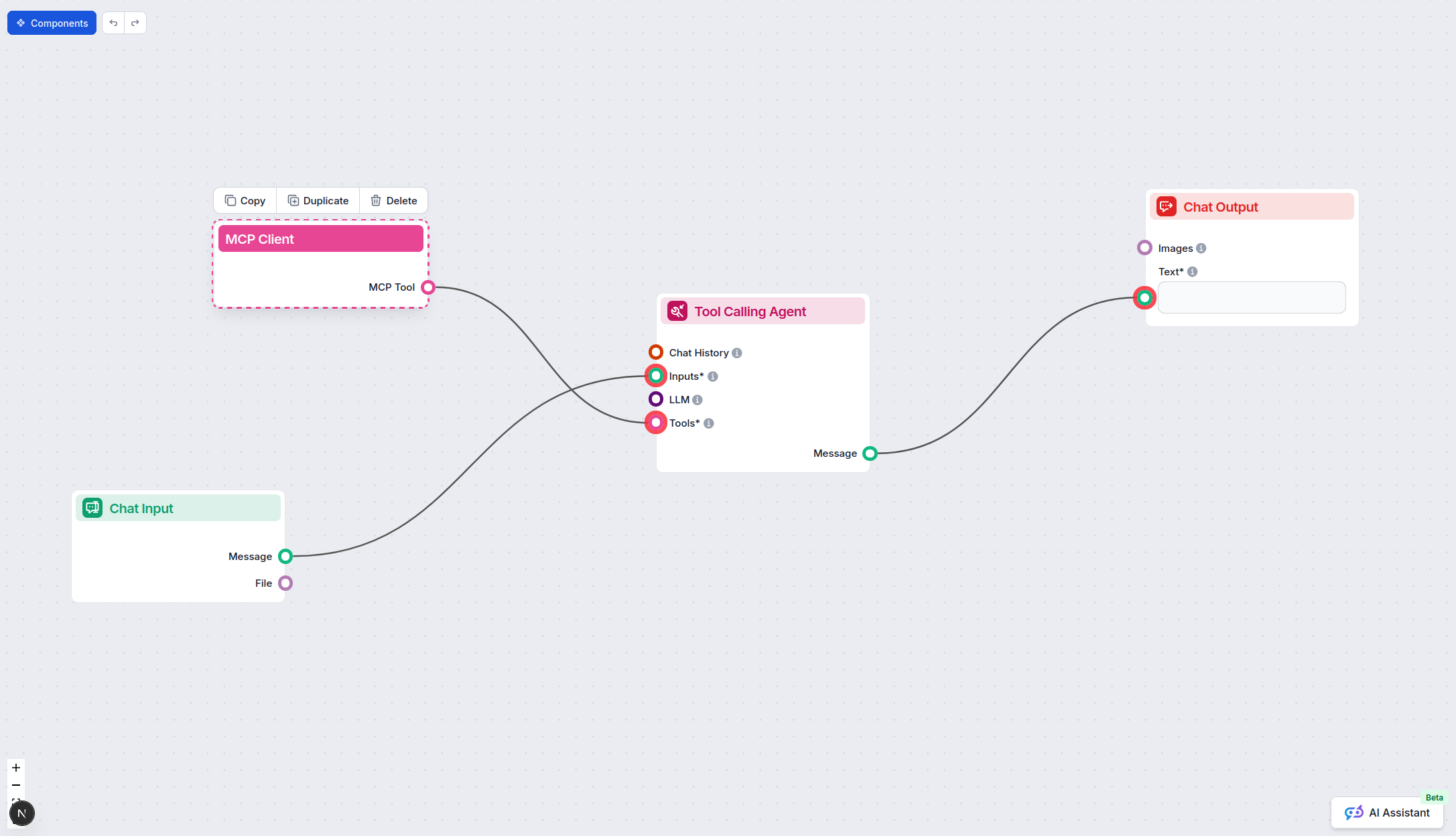

MCP gebruiken in FlowHunt

Om MCP-servers in je FlowHunt-workflow te integreren, voeg je het MCP-component toe aan je flow en koppel je deze aan je AI-agent:

Klik op het MCP-component om het configuratiescherm te openen. Vul in het systeem-MCP-configuratiegedeelte je MCP-servergegevens in met dit JSON-formaat:

{

"cursor-talk-to-figma": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Na configuratie kan de AI-agent deze MCP nu als tool gebruiken en heeft toegang tot alle functies en mogelijkheden. Vergeet niet om “cursor-talk-to-figma” te vervangen door de daadwerkelijke naam van je MCP-server en de URL aan te passen naar je eigen MCP-server URL.

Overzicht

| Sectie | Beschikbaarheid | Details/Opmerkingen |

|---|---|---|

| Overzicht | ✅ | Uitgebreid in readme.md en projectbeschrijving |

| Lijst met Prompts | ⛔ | Geen prompt-sjablonen gevonden |

| Lijst met Resources | ⛔ | Niet expliciet vermeld |

| Lijst met Tools | ⛔ | Niet expliciet vermeld |

| API-sleutels beveiligen | ✅ | Voorbeeld met omgevingsvariabele gegeven |

| Sampling-ondersteuning (minder belangrijk) | ⛔ | Geen vermelding gevonden |

De repository biedt een robuuste integratie voor Figma-automatisering via MCP, maar mist gedetailleerde documentatie over prompts, tools en resources. De installatie-instructies en toepassingen zijn duidelijk en praktisch, maar diepgaandere MCP-specifieke functies (roots, sampling, enz.) zijn niet gedocumenteerd.

MCP Score

| Heeft een LICENSE | ✅ (MIT) |

|---|---|

| Minimaal één tool | ⛔ |

| Aantal forks | 433 |

| Aantal sterren | 4.4k |

Mening en beoordeling:

Gebaseerd op bovenstaande tabellen verdient deze MCP-server een 6/10. Hij is populair, wordt actief gebruikt en biedt duidelijke installatie en waardevolle integratie, maar mist expliciete documentatie voor MCP-prompts, resources en tooling, en toont geen bewijs van roots- of sampling-ondersteuning.

Veelgestelde vragen

- Wat is de Cursor Talk To Figma MCP Server?

Het is een integratielaag die de Cursor AI-ontwikkelomgeving verbindt met Figma via het Model Context Protocol (MCP), zodat AI-assistenten en ontwikkelaars Figma-ontwerpen programmatisch kunnen lezen, analyseren en aanpassen voor workflowautomatisering.

- Wat zijn de belangrijkste toepassingen van deze server?

Belangrijke toepassingen zijn bulkvervanging van tekstinhoud, het doorvoeren van instance overrides in ontwerp-systemen, het automatiseren van ontwerptaken (zoals stijl- of lay-outwijzigingen), Figma integreren met AI-agenten voor ontwerpanalyse of snel prototypen, en het overbruggen van ontwikkel- en ontwerpworkflows.

- Hoe beveilig ik mijn Figma API-sleutels?

Sla je FIGMA_API_KEY altijd op in omgevingsvariabelen en verwijs ernaar binnen je MCP-serverconfiguratie onder de velden 'env' en 'inputs' om te voorkomen dat gevoelige gegevens in de code zichtbaar zijn.

- Biedt de server prompt-sjablonen of expliciete tools?

Er worden geen expliciete prompt-sjablonen, MCP-resources of tools genoemd in de repository of serverdocumentatie. De integratie richt zich op het mogelijk maken van Figma-toegang via MCP-eindpunten voor automatisering.

- Hoe koppel ik deze MCP-server in FlowHunt?

Voeg het MCP-onderdeel toe aan je FlowHunt-flow en configureer vervolgens het systeem-MCP met je servergegevens, waarbij je het transport en de server-URL specificeert. Zo kan je AI-agent Figma-functies via MCP gebruiken.

- Wat is de algemene beoordeling van deze MCP-server?

Het is robuust, wordt actief gebruikt en heeft duidelijke installatie-instructies, wat resulteert in een score van 6/10. Er ontbreekt echter expliciete documentatie voor MCP-prompts, resources en geavanceerde functies zoals roots en sampling.

Stroomlijn Figma-workflows met AI

Integreer de Cursor Talk To Figma MCP Server om ontwerptaken te automatiseren, prototypen te versnellen en bruggen te slaan tussen ontwikkel- en ontwerpteams met behulp van AI.