Rozpoznawanie koreferencji

Rozpoznawanie koreferencji łączy wyrażenia odnoszące się do tej samej jednostki w tekście, umożliwiając maszynom zrozumienie kontekstu i rozwiązywanie dwuznaczności dla lepszych zastosowań NLP.

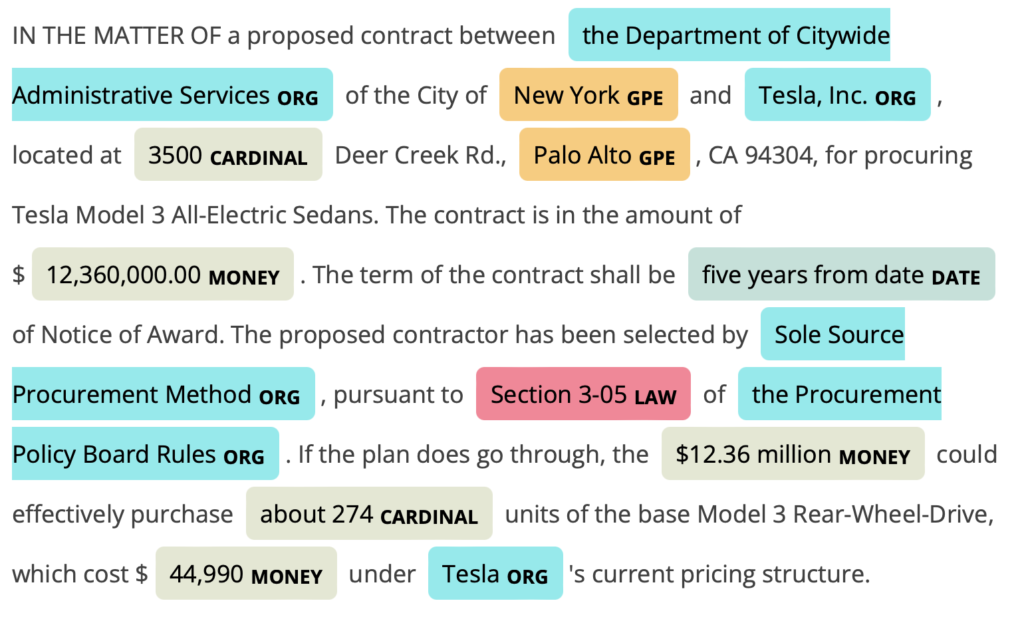

Rozpoznawanie koreferencji to fundamentalne zadanie w przetwarzaniu języka naturalnego (NLP), polegające na identyfikacji i łączeniu wyrażeń w tekście, które odnoszą się do tej samej jednostki. Rozstrzyga, kiedy dwa lub więcej słów lub fraz w tekście dotyczy tej samej rzeczy lub osoby. Ten proces jest kluczowy, aby maszyny mogły zrozumieć i spójnie interpretować tekst, podczas gdy ludzie naturalnie dostrzegają powiązania między zaimkami, nazwami i innymi wyrażeniami referencyjnymi.

Rozpoznawanie koreferencji stanowi integralną część aplikacji NLP, takich jak streszczanie dokumentów, odpowiadanie na pytania, tłumaczenie maszynowe, analiza sentymentu i ekstrakcja informacji. Odgrywa kluczową rolę w poprawie zdolności maszyn do przetwarzania i rozumienia ludzkiego języka poprzez rozstrzyganie niejednoznaczności i dostarczanie kontekstu.

Kluczowe punkty:

- Semantyka i zrozumienie kontekstu: Rozpoznawanie koreferencji wspomaga rozumienie semantyczne poprzez rozstrzyganie zaimków i fraz rzeczownikowych do ich poprzedników, umożliwiając spójną interpretację tekstu. To kluczowy krok do zrozumienia struktury narracyjnej i dyskursu.

- Złożoność przetwarzania języka: Język jest z natury niejednoznaczny i zależny od kontekstu. Rozpoznawanie koreferencji radzi sobie z tą złożonością, łącząc odniesienia, co jest istotne w zadaniach takich jak analiza opinii czy streszczanie.

- Rola w rozstrzyganiu niejednoznaczności: Pomaga rozstrzygać, do jakiej jednostki odnosi się dane słowo czy fraza, zwłaszcza w tekstach z wieloma podmiotami.

- Wzmacnianie modeli uczenia maszynowego: Poprawiając rozumienie kontekstu tekstu, rozpoznawanie koreferencji zwiększa skuteczność modeli uczenia maszynowego w zadaniach NLP.

Rodzaje rozpoznawania koreferencji

- Rozpoznawanie anafory: Rozstrzyganie wyrażeń, w których zaimek lub inne słowo referencyjne odnosi się do wcześniej wspomnianej jednostki.

Przykład: „Jan poszedł do sklepu, bo potrzebował mleka.” („potrzebował” odnosi się do „Jan”) - Rozpoznawanie katafory: Rozstrzyganie odniesień, w których zaimek lub słowo referencyjne pojawia się przed jednostką, do której się odnosi.

Przykład: „Ponieważ był zmęczony, Jan poszedł wcześnie spać.” („był zmęczony” odnosi się do „Jan”) - Rozpoznawanie zwrotne: Dotyczy wyrażeń, które odnoszą się do samego siebie.

Przykład: „Jan kopnął siebie.” - Rozpoznawanie elipsy: Wypełnianie luk pozostawionych przez opuszczenia w tekście.

Przykład: „Ja zrobię, jeśli ty zrobisz.” (Brakujące słowa należy wywnioskować z kontekstu) - Rozstrzyganie niejednoznaczności: Dotyczy przypadków, gdy odniesienia mogą mieć wiele znaczeń.

Przykład: „Widziałem jej kaczkę.” (Może oznaczać obserwację jej zwierzęcia lub ruchu głową)

Zastosowania rozpoznawania koreferencji

Rozpoznawanie koreferencji stosuje się w różnych zadaniach NLP, usprawniając interakcję człowiek-komputer. Kluczowe zastosowania to:

- Streszczanie dokumentów: Zapewnia spójność generowanych streszczeń poprzez łączenie zaimków i fraz rzeczownikowych z ich odpowiednimi poprzednikami.

- Systemy odpowiadania na pytania: Dokładna interpretacja zapytań użytkownika wymaga rozpoznawania koreferencji. Łącząc zaimki i nazwy własne z ich odniesieniami, systemy mogą zapewnić precyzyjne i kontekstowo trafne odpowiedzi.

- Tłumaczenie maszynowe: Kluczowe dla zachowania spójności referencyjnej między językiem źródłowym a docelowym, zapewniając, że przetłumaczony tekst zachowuje zamierzone znaczenie i spójność.

- Analiza sentymentu: Poprzez identyfikację podmiotu i dopełnienia czasowników oraz przymiotników, rozpoznawanie koreferencji pomaga określić ton emocjonalny zdania.

- Konwersacyjna AI: W chatbotach i wirtualnych asystentach rozpoznawanie koreferencji umożliwia maszynom zrozumienie i śledzenie odniesień w trakcie rozmowy, zapewniając ciągłość i zachowanie kontekstu.

Wyzwania w rozpoznawaniu koreferencji

Mimo swojego znaczenia, rozpoznawanie koreferencji wiąże się z wieloma wyzwaniami:

- Niejednoznaczność: Słowa takie jak „to” czy „oni” mogą mieć wiele możliwych poprzedników, co prowadzi do niejasności interpretacyjnych.

- Różnorodność wyrażeń: Do tej samej jednostki można odnosić się za pomocą różnych wyrażeń, co utrudnia identyfikację wszystkich odniesień.

- Niuanse kontekstowe: Zrozumienie kontekstu, w którym występują odniesienia, jest kluczowe, gdyż znaczenie może się zmieniać w zależności od otoczenia.

- Dwuznaczności na poziomie dyskursu: Większe fragmenty tekstu mogą zawierać dodatkowe niejasności, które utrudniają ustalenie zamierzonego odniesienia.

- Wyzwania językowe: Języki o złożonej strukturze gramatycznej, jak chiński czy arabski, stawiają dodatkowe wyzwania dla rozpoznawania koreferencji.

Techniki rozpoznawania koreferencji

Do rozpoznawania koreferencji stosuje się różne techniki:

- Podejścia oparte na regułach: Wykorzystują reguły lingwistyczne do łączenia zaimków z ich poprzednikami na podstawie relacji gramatycznych i struktur składniowych.

- Podejścia oparte na uczeniu maszynowym: Polegają na trenowaniu modeli na oznaczonych zbiorach danych, wykorzystując cechy takie jak zależności składniowe, role gramatyczne i informacje semantyczne.

- Techniki głębokiego uczenia: Wykorzystują modele, takie jak rekurencyjne sieci neuronowe (RNN) i architektury transformerowe, aby efektywnie uchwycić informacje kontekstowe.

- Podejścia typu sieve: Stosują szereg uporządkowanych heurystyk (tzw. „sieves”), by stopniowo rozstrzygać koreferencje.

- Podejścia skupione na jednostkach: Koncentrują się na reprezentacji całych jednostek, a nie pojedynczych wzmianek, uwzględniając ich całościowy kontekst.

- Podejścia hybrydowe: Łączą zalety metod opartych na regułach i uczeniu maszynowym.

Systemy rozpoznawania koreferencji

Do rozpoznawania koreferencji używa się wielu nowoczesnych modeli i systemów:

- Stanford CoreNLP: Łączy podejścia oparte na regułach i uczeniu maszynowym, oferując narzędzia do różnych zadań NLP, w tym rozpoznawania koreferencji.

- Modele oparte na BERT: Wykorzystują architekturę Bidirectional Encoder Representations from Transformers (BERT) do uchwycenia kontekstowych osadzeń i lepszego rozumienia.

- Rozpoznawanie koreferencji na poziomie słów: Skupia się na klasteryzacji na poziomie tokenów, zmniejszając złożoność obliczeniową w porównaniu do systemów opartych na fragmentach.

Ocena rozpoznawania koreferencji

Ocena skuteczności systemów rozpoznawania koreferencji obejmuje kilka miar:

- MUC (Mention-based Unification Coefficient): Mierzy precyzję i czułość identyfikowanych par wzmianek koreferencyjnych.

- B-CUBED: Ocenia precyzję, czułość i F1 na poziomie wzmianek, kładąc nacisk na równowagę pomiędzy precyzją a czułością.

- CEAF (Constrained Entity-Alignment F-measure): Mierzy zgodność łańcuchów koreferencyjnych pomiędzy wynikami systemu a danymi referencyjnymi.

Kierunki rozwoju

Przyszłość rozpoznawania koreferencji obejmuje kilka obiecujących kierunków:

- Integracja podejść symbolicznych i neuronowych: Łączenie zalet obu paradygmatów dla poprawy interpretowalności i odporności modeli.

- Wielojęzyczne rozpoznawanie koreferencji: Tworzenie modeli zdolnych do obsługi niuansów różnych języków i kultur.

- Wykorzystanie wiedzy ogólnej: Włączanie zewnętrznych baz wiedzy i rozumowania zdroworozsądkowego dla zwiększenia dokładności.

- Aspekty etyczne i ograniczanie uprzedzeń: Tworzenie uczciwych i bezstronnych systemów rozpoznawania koreferencji.

- Obsługa dynamicznych i zmieniających się kontekstów: Tworzenie modeli zdolnych do adaptacji w czasie rzeczywistym i w zmieniających się sytuacjach.

Rozpoznawanie koreferencji to kluczowy aspekt NLP, łączący maszynowe rozumienie z ludzką komunikacją poprzez rozstrzyganie odniesień i niejednoznaczności w języku. Jego zastosowania są szerokie i różnorodne, obejmując dziedziny od automatyzacji AI po chatboty, gdzie rozumienie ludzkiego języka jest kluczowe.

Rozpoznawanie koreferencji: kluczowe osiągnięcia i badania

Rozpoznawanie koreferencji to istotne zadanie w przetwarzaniu języka naturalnego (NLP), polegające na określeniu, kiedy dwa lub więcej wyrażeń w tekście odnosi się do tej samej jednostki. Zadanie to jest kluczowe dla wielu zastosowań, takich jak ekstrakcja informacji, streszczanie tekstu czy odpowiadanie na pytania.

Najważniejsze osiągnięcia badawcze ostatnich lat:

Rozkładanie rozpoznawania koreferencji zdarzeń na rozwiązywalne podzadania:

Ahmed i in. (2023) proponują nowe podejście do rozpoznawania koreferencji zdarzeń (ECR), dzieląc problem na dwa łatwiejsze do zarządzania podzadania. Tradycyjne metody borykają się z nierównomierną dystrybucją par koreferencyjnych i niekoreferencyjnych oraz dużą złożonością obliczeniową. Ich podejście wprowadza heurystykę do efektywnego filtrowania par niekoreferencyjnych oraz zbalansowaną metodę treningową, osiągając wyniki porównywalne z najlepszymi modelami przy mniejszych wymaganiach obliczeniowych. Autorzy analizują także wyzwania związane z klasyfikacją trudnych par wzmianek.

Czytaj więcejIntegracja baz wiedzy w domenie chemicznej:

Lu i Poesio (2024) zajmują się rozpoznawaniem koreferencji i powiązań w patentach chemicznych poprzez włączenie wiedzy zewnętrznej do modelu uczenia wielozadaniowego. Ich badania podkreślają znaczenie wiedzy domenowej dla zrozumienia procesów chemicznych i pokazują, że jej integracja poprawia zarówno rozpoznawanie koreferencji, jak i powiązań. Praca ta wskazuje na potencjał adaptacji domenowej w zwiększaniu skuteczności zadań NLP.Rozpoznawanie koreferencji w ekstrakcji relacji dialogowych:

Xiong i in. (2023) rozszerzają istniejący zbiór DialogRE do wersji DialogRE^C+, skupiając się na tym, jak rozpoznawanie koreferencji wspiera ekstrakcję relacji w dialogu (DRE). Wprowadzając łańcuchy koreferencyjne do scenariuszy DRE, wspomagają rozumowanie o relacjach argumentów. Zbiór zawiera ręcznie oznaczone 5 068 łańcuchów koreferencyjnych różnych typów, takich jak łańcuchy mówiących i organizacji. Autorzy opracowują modele grafowe DRE wykorzystujące wiedzę o koreferencji, demonstrując poprawę wydajności w ekstrakcji relacji z dialogów. Praca ta podkreśla praktyczne zastosowanie rozpoznawania koreferencji w złożonych systemach dialogowych.

Badania te stanowią istotny postęp w dziedzinie rozpoznawania koreferencji, prezentując innowacyjne metody i zastosowania, które rozwiązują wyzwania tego skomplikowanego zadania NLP.

Najczęściej zadawane pytania

- Czym jest rozpoznawanie koreferencji w NLP?

Rozpoznawanie koreferencji to proces identyfikowania, kiedy dwa lub więcej wyrażeń w tekście odnosi się do tej samej jednostki, na przykład łączenie zaimków z rzeczownikami, do których się odnoszą. Jest to kluczowe dla maszynowego rozumienia i spójnej interpretacji języka.

- Gdzie wykorzystywane jest rozpoznawanie koreferencji?

Rozpoznawanie koreferencji stosuje się w streszczaniu dokumentów, systemach odpowiadania na pytania, tłumaczeniach maszynowych, analizie sentymentu oraz konwersacyjnej AI, aby poprawić zrozumienie przez maszyny i śledzenie kontekstu.

- Jakie są główne techniki rozpoznawania koreferencji?

Techniki obejmują podejścia oparte na regułach, modele uczenia maszynowego, uczenie głębokie (np. architektury transformerowe), metody typu sieve, podejścia skupione na jednostkach oraz hybrydowe systemy łączące różne metody.

- Jakie wyzwania napotyka rozpoznawanie koreferencji?

Wyzwania obejmują niejednoznaczność odniesień, różnorodność wyrażeń dla jednostek, niuanse kontekstowe, dwuznaczności na poziomie dyskursu oraz złożoności specyficzne dla danego języka.

- Jakie są wiodące systemy do rozpoznawania koreferencji?

Znane systemy to Stanford CoreNLP, modele oparte na BERT oraz systemy rozpoznawania koreferencji na poziomie słów, z których każdy oferuje różne podejścia do łączenia jednostek w tekście.

Gotowy, by zbudować własną AI?

Inteligentne chatboty i narzędzia AI w jednym miejscu. Łącz intuicyjne bloki, aby zamienić swoje pomysły w zautomatyzowane Flow.