Dowolny serwer MCP OpenAPI

Umożliwiaj asystentom AI semantyczne wykrywanie, odczytywanie i interakcję z dowolnym API zgodnym z OpenAPI. Idealne do dynamicznej integracji prywatnych API w FlowHunt.

Do czego służy “Dowolny serwer MCP OpenAPI”?

“Dowolny serwer MCP OpenAPI” to narzędzie zaprojektowane do łączenia asystentów AI — takich jak Claude — z dowolnym zewnętrznym API udostępniającym specyfikację OpenAPI (Swagger). Umożliwia semantyczne przeszukiwanie rozbudowanych dokumentacji OpenAPI, inteligentnie dzieląc endpointy na fragmenty, co pozwala na ich szybkie wykrywanie i interakcję. Dzięki temu klienci AI mogą znajdować istotne endpointy API poprzez zapytania w języku naturalnym (np. “wylistuj produkty”), natychmiast pobierać pełną dokumentację endpointów i wykonywać zapytania API bezpośrednio z serwera. Serwer ten idealnie nadaje się do integracji prywatnych lub dużych API z przepływami pracy opartymi na AI, usprawniając operacje, takie jak zapytania do baz danych czy niestandardowe integracje API, bez konieczności częstych ręcznych aktualizacji.

Lista promptów

Brak konkretnych szablonów promptów wymienionych w dostępnej dokumentacji lub kodzie.

Lista zasobów

W dostępnej dokumentacji lub kodzie nie opisano ani nie wymieniono jawnych zasobów MCP.

Lista narzędzi

- custom_api_request_schema

Wykryj odpowiednie endpointy API, wykonując semantyczne wyszukiwanie w specyfikacji OpenAPI. Narzędzie udostępnia fragmenty dokumentacji endpointów na podstawie zapytań w języku naturalnym. - custom_make_request

Wykonaj zapytanie API do wybranego endpointu. Umożliwia asystentowi AI bezpośrednią interakcję z API, przesyłanie żądań i odbieranie odpowiedzi.

Przykładowe zastosowania tego serwera MCP

- Integracja API dla usług prywatnych

Bezproblemowo łącz Claude’a lub innych asystentów z prywatnymi API, udostępniając URL do dokumentacji OpenAPI w formacie JSON, zapewniając bezpieczną i dynamiczną interakcję z systemami wewnętrznymi. - Szybkie wykrywanie endpointów

Wykorzystaj wyszukiwanie semantyczne w pamięci (napędzane przez FAISS i MiniLM-L3), aby błyskawicznie znajdować odpowiednie endpointy API nawet w rozbudowanych i złożonych dokumentacjach OpenAPI. - Automatyczne wykonywanie zapytań API

Pozwól klientom AI nie tylko wykrywać, ale i wykonywać zapytania API, umożliwiając automatyzację takich przepływów jak wylistowanie produktów, zarządzanie zamówieniami czy wyszukiwanie użytkowników — bez dodatkowych narzędzi. - Dostęp do kontekstowej dokumentacji API

Natychmiast pobieraj dokumentację dotyczącą konkretnych endpointów, wspierając szczegółowe odkrywanie parametrów i zastosowań do automatyzacji opartej na AI. - Integracja z Claude Desktop lub podobnymi klientami

Zaprojektowany do współpracy z klientem MCP Claude’a, pozwala obejść ograniczenia wielkości dokumentacji i umożliwia praktyczne korzystanie z dużych API w aplikacjach desktopowych AI.

Jak skonfigurować

Windsurf

- Upewnij się, że masz zainstalowane Node.js i Windsurf.

- Zlokalizuj plik konfiguracyjny Windsurf.

- Dodaj wpis

@any-openapi/mcp-server@latestdo obiektumcpServers. - Podaj komendę oraz potrzebne zmienne środowiskowe (np.

OPENAPI_JSON_DOCS_URL). - Zapisz i zrestartuj Windsurf, następnie sprawdź, czy serwer pojawił się na liście.

Przykładowy JSON:

{

"mcpServers": {

"any-openapi": {

"command": "npx",

"args": ["@any-openapi/mcp-server@latest"],

"env": {

"OPENAPI_JSON_DOCS_URL": "https://yourapi.com/openapi.json"

}

}

}

}

Zabezpieczanie kluczy API:

{

"env": {

"API_KEY": "${ANY_OPENAPI_API_KEY}"

},

"inputs": {

"apiKey": "${ANY_OPENAPI_API_KEY}"

}

}

Claude

- Upewnij się, że Claude obsługuje integrację serwerów MCP.

- Otwórz ustawienia lub panel konfiguracyjny serwerów MCP.

- Wprowadź szczegóły serwera wraz z komendą i zmiennymi środowiskowymi.

- Zapisz zmiany i zrestartuj Claude, jeśli to konieczne.

- Potwierdź, że serwer jest widoczny i aktywny.

Przykładowy JSON:

{

"mcpServers": {

"any-openapi": {

"command": "npx",

"args": ["@any-openapi/mcp-server@latest"],

"env": {

"OPENAPI_JSON_DOCS_URL": "https://yourapi.com/openapi.json"

}

}

}

}

Cursor

- Zainstaluj Cursor i przejdź do sekcji konfiguracji serwerów MCP.

- Dodaj nowy wpis MCP z paczką

@any-openapi/mcp-server@latest. - Ustaw wymagane zmienne środowiskowe dla Twojego API.

- Zapisz konfigurację i zrestartuj Cursor.

- Zweryfikuj integrację, wyświetlając dostępne narzędzia.

Przykładowy JSON:

{

"mcpServers": {

"any-openapi": {

"command": "npx",

"args": ["@any-openapi/mcp-server@latest"],

"env": {

"OPENAPI_JSON_DOCS_URL": "https://yourapi.com/openapi.json"

}

}

}

}

Cline

- Otwórz plik konfiguracyjny Cline.

- Dodaj konfigurację serwera MCP dla

@any-openapi/mcp-server@latest. - Ustaw wymagane zmienne środowiskowe.

- Zapisz i zrestartuj Cline.

- Upewnij się, że serwer znajduje się na liście aktywnych serwerów MCP.

Przykładowy JSON:

{

"mcpServers": {

"any-openapi": {

"command": "npx",

"args": ["@any-openapi/mcp-server@latest"],

"env": {

"OPENAPI_JSON_DOCS_URL": "https://yourapi.com/openapi.json"

}

}

}

}

Zabezpieczanie kluczy API:

Używaj zmiennych środowiskowych jak powyżej, by nie ujawniać wrażliwych danych.

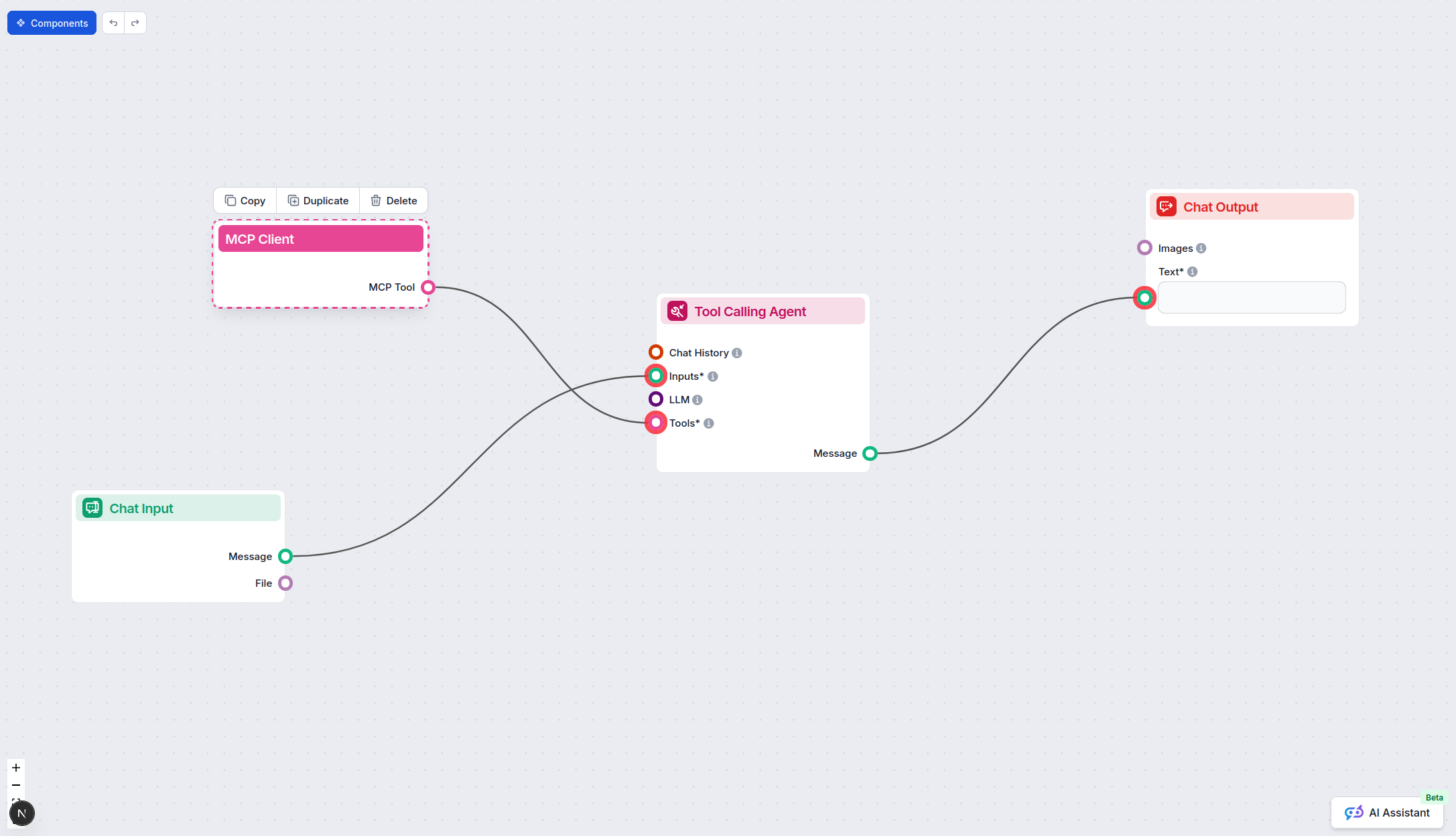

Jak używać tego MCP w przepływach

Używanie MCP w FlowHunt

Aby zintegrować serwery MCP z przepływem pracy w FlowHunt, rozpocznij od dodania komponentu MCP do swojego przepływu i połącz go z agentem AI:

Kliknij komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji systemowej MCP wstaw szczegóły swojego serwera MCP w tym formacie JSON:

{

"any-openapi": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI może korzystać z tego MCP jako narzędzia z dostępem do wszystkich jego funkcji i możliwości. Pamiętaj, by zmienić “any-openapi” na faktyczną nazwę Twojego serwera MCP i podać poprawny adres URL.

Podsumowanie

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | |

| Lista promptów | ⛔ | Brak znalezionych |

| Lista zasobów | ⛔ | Brak znalezionych |

| Lista narzędzi | ✅ | Dwa narzędzia: wykrywanie & wykonanie |

| Zabezpieczanie kluczy API | ✅ | Poprzez zmienne środowiskowe |

| Wsparcie próbkowania (mało istotne przy ocenie) | ⛔ | Nie wspomniano |

Wsparcie dla roots: Nie określono w dostępnej dokumentacji lub kodzie.

Na podstawie dostarczonej dokumentacji i powyższego zestawienia, ten serwer MCP jest wyspecjalizowany, funkcjonalny i dobrze dostosowany do integracji API oraz dynamicznego wykrywania endpointów, choć nie posiada jawnych przykładowych promptów/zasobów ani dokumentacji dotyczącej próbkowania czy obsługi roots. Jego konfiguracja i praktyki bezpieczeństwa są czytelne i standardowe.

Nasza opinia

Ten serwer MCP jest bardzo praktyczny dla programistów potrzebujących integracji rozbudowanych lub prywatnych API z asystentami AI, szczególnie z Claude’em. Jego użyteczność jest wysoka pod kątem semantycznego wykrywania endpointów i bezpośredniego wykonywania zapytań API, choć przydałaby się pełniejsza dokumentacja i definicja zasobów. Ogólnie to solidny, wyspecjalizowany serwer, choć nie w pełni kompleksowy przykład wszystkich możliwości MCP.

Ocena: 7/10

Ocena MCP

| Posiada LICENCJĘ | ✅ (MIT) |

|---|---|

| Ma przynajmniej jedno narzędzie | ✅ |

| Liczba forków | 12 |

| Liczba gwiazdek | 52 |

Najczęściej zadawane pytania

- Do czego służy Dowolny serwer MCP OpenAPI?

Pozwala asystentom AI, takim jak Claude, łączyć się z dowolnym zewnętrznym API udostępniającym specyfikację OpenAPI (Swagger). Umożliwia inteligentne, semantyczne wykrywanie endpointów i bezpośrednie wykonywanie zapytań API, dzięki czemu integracja prywatnych lub rozbudowanych API jest bezproblemowa.

- Jakie asystenty AI lub klienci są obsługiwani?

Serwer jest zaprojektowany dla Claude'a, ale działa z dowolnym klientem AI obsługującym serwery MCP, w tym Windsurf, Cursor i Cline.

- Jak działa wykrywanie endpointów?

Wykorzystuje wyszukiwanie semantyczne w pamięci (FAISS z MiniLM-L3), aby znaleźć odpowiednie endpointy w dokumentach OpenAPI na podstawie zapytań w języku naturalnym.

- Czy używanie kluczy API z tym serwerem jest bezpieczne?

Tak. Zawsze używaj zmiennych środowiskowych do kluczy API i innych wrażliwych danych, jak pokazano w przykładach konfiguracji.

- Czy serwer może wykonywać rzeczywiste zapytania API?

Tak. Po wykryciu odpowiedniego endpointu serwer umożliwia AI wykonywanie zapytań API, pobierając na żywo dane lub wykonując operacje za pomocą API.

- Jakie są typowe przypadki użycia?

Integracja prywatnych API, automatyzacja przepływów takich jak wystawianie produktów lub zarządzanie użytkownikami oraz szybkie wykrywanie i wykorzystanie endpointów w dużych API.

Zintegruj dowolne API z Dowolnym serwerem MCP OpenAPI FlowHunt

Zwiększ możliwości swoich przepływów AI, łącząc Claude'a lub innych asystentów z dowolnym API opartym na OpenAPI. Doświadcz bezproblemowych, bezpiecznych i dynamicznych integracji API!