DeepSeek MCP Server

DeepSeek MCP Server działa jako skoncentrowany na prywatności most między Twoimi aplikacjami a modelami językowymi DeepSeek, umożliwiając bezpieczne i skalowalne integracje AI.

Co robi serwer „DeepSeek” MCP?

DeepSeek MCP Server to serwer Model Context Protocol (MCP) zaprojektowany do integracji zaawansowanych modeli językowych DeepSeek z aplikacjami zgodnymi z MCP, takimi jak Claude Desktop. Działając jako most, umożliwia asystentom AI połączenie z API DeepSeek, ułatwiając takie zadania jak generowanie języka, analiza tekstu i wiele innych. Serwer działa jako proxy, zapewniając, że żądania API są obsługiwane bezpiecznie i anonimowo — dla API DeepSeek widoczny jest wyłącznie serwer proxy, a nie klient. Takie rozwiązanie zwiększa prywatność, usprawnia integrację przepływów pracy i umożliwia deweloperom oraz narzędziom AI korzystanie z możliwości DeepSeek w celu lepszego rozwoju, badań i automatyzacji.

Lista promptów

W repozytorium ani dokumentacji nie wymieniono szablonów promptów.

Lista zasobów

W repozytorium ani README nie udokumentowano jawnych zasobów MCP.

Lista narzędzi

W README ani w treści repozytorium nie opisano jawnej listy narzędzi lub funkcji narzędziowych.

Przykłady zastosowania tego serwera MCP

- Zanonimizowany dostęp do API: Programiści mogą bezpiecznie korzystać z modeli językowych DeepSeek, ponieważ serwer działa jako proxy, chroniąc tożsamość klienta i klucze API.

- Integracja z aplikacjami zgodnymi z MCP: Umożliwia bezproblemowe wykorzystanie modeli DeepSeek w narzędziach takich jak Claude Desktop i potencjalnie innych wspierających MCP.

- Usprawnione przepływy AI: Pozwala programistom i badaczom automatyzować generowanie treści, podsumowania lub analizę z wykorzystaniem modeli DeepSeek w istniejących systemach MCP.

- Rozwój z zachowaniem prywatności: Odpowiedni w sytuacjach, gdy istotne jest unikanie bezpośredniej ekspozycji API, zachowując prywatność i zgodność.

- Skalowalny dostęp do modeli językowych: Ułatwia skalowalny i ustandaryzowany dostęp do modeli językowych DeepSeek na różnych platformach AI i automatyzacji.

Jak skonfigurować

Windsurf

- Upewnij się, że na Twoim systemie zainstalowany jest Node.js.

- Zlokalizuj plik konfiguracyjny Windsurf (np.

windsurf.config.json). - Dodaj serwer DeepSeek MCP do sekcji

mcpServersz odpowiednim poleceniem i argumentami. - Zapisz plik konfiguracyjny i uruchom ponownie Windsurf.

- Zweryfikuj, czy serwer działa i jest dostępny z poziomu Windsurf.

{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

Claude

- Upewnij się, że Node.js jest zainstalowany.

- Otwórz plik konfiguracyjny Claude.

- Wstaw konfigurację DeepSeek MCP Server do obiektu

mcpServers. - Zapisz i uruchom ponownie Claude.

- Potwierdź dostępność DeepSeek MCP Server, uruchamiając prompt testowy.

{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

Cursor

- Upewnij się, że Node.js jest dostępny.

- Edytuj plik konfiguracyjny Cursor.

- Dodaj konfigurację DeepSeek MCP Server do sekcji

mcpServers. - Zapisz zmiany i uruchom ponownie Cursor.

- Przetestuj integrację, uruchamiając obsługiwane zadanie.

{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

Cline

- Zainstaluj Node.js, jeśli nie jest obecny.

- Otwórz plik konfiguracyjny Cline.

- Dodaj wpis DeepSeek MCP Server do

mcpServers. - Zapisz i uruchom ponownie Cline.

- Zweryfikuj działanie na przykładzie żądania testowego.

{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

Zabezpieczanie kluczy API

Dla bezpieczeństwa przechowuj klucz API DeepSeek w zmiennej środowiskowej. Przekaż go do serwera przez sekcję env:

{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"],

"env": {

"DEEPSEEK_API_KEY": "${DEEPSEEK_API_KEY}"

}

}

}

}

Jak używać tego MCP w przepływach

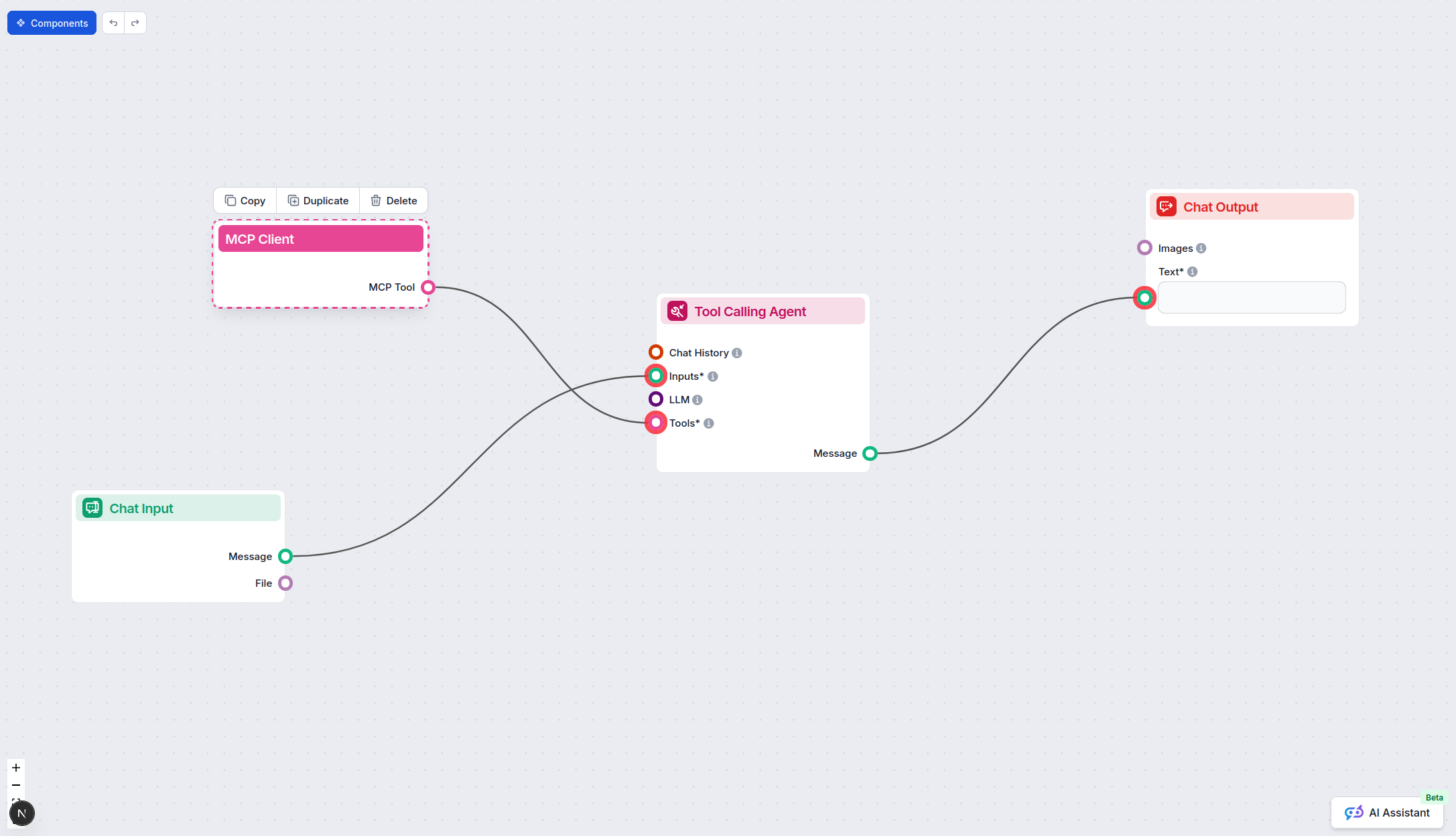

Użycie MCP w FlowHunt

Aby zintegrować serwery MCP ze swoim przepływem pracy w FlowHunt, zacznij od dodania komponentu MCP do swojego flow i połącz go z agentem AI:

Kliknij komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji systemu MCP wstaw dane swojego serwera MCP, używając następującego formatu JSON:

{

"deepseek-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI będzie mógł korzystać z tego MCP jako narzędzia z dostępem do wszystkich jego funkcji oraz możliwości. Pamiętaj, by zmienić “deepseek-mcp” na faktyczną nazwę swojego serwera MCP i podać własny adres URL serwera MCP.

Podsumowanie

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | Przegląd obecny w README |

| Lista promptów | ⛔ | Brak szablonów promptów |

| Lista zasobów | ⛔ | Brak udokumentowanych zasobów MCP |

| Lista narzędzi | ⛔ | Brak opisanych narzędzi |

| Zabezpieczanie kluczy API | ✅ | Przykład podany z użyciem zmiennych środowiskowych |

| Sampling Support (mało istotne przy ocenie) | ⛔ | Brak wzmianki o wsparciu samplingowym |

Wsparcie dla roots: Nie wspomniane

Oceniam ten serwer MCP na 4/10 pod względem dokumentacji i praktycznego zastosowania na podstawie README i zawartości repozytorium. Choć konfiguracja i kwestie prywatności są opisane jasno, brak szczegółów dotyczących promptów, zasobów i narzędzi ogranicza użyteczność w zaawansowanych przepływach MCP.

Ocena MCP

| Czy posiada LICENSE | ✅ (MIT) |

|---|---|

| Przynajmniej jedno narzędzie | ⛔ |

| Liczba forków | 32 |

| Liczba gwiazdek | 242 |

Najczęściej zadawane pytania

- Czym jest DeepSeek MCP Server?

DeepSeek MCP Server to proxy integrujące modele językowe DeepSeek z aplikacjami zgodnymi z MCP, zapewniające bezpieczny, zanonimizowany dostęp do API DeepSeek do zadań takich jak generowanie i analiza tekstu.

- W jaki sposób DeepSeek MCP Server zwiększa prywatność?

Działa jako proxy, co oznacza, że API DeepSeek widzi tylko serwer proxy, a nie klienta. Zapewnia to anonimową obsługę żądań API, chroniąc tożsamość klienta i klucze API.

- Jakie są typowe zastosowania tego serwera MCP?

Zastosowania obejmują integrację modeli DeepSeek z narzędziami deweloperskimi, automatyzację generowania lub analizy treści, umożliwianie przepływów AI dbających o prywatność oraz skalowalny dostęp do modeli językowych w systemach opartych o MCP.

- Jak zabezpieczyć klucz API DeepSeek?

Przechowuj klucz API jako zmienną środowiskową i przekazuj go do serwera za pomocą sekcji `env` w konfiguracji. Zapobiega to przypadkowemu ujawnieniu w kodzie lub logach.

- Czy są dostępne szablony promptów lub narzędzia?

Nie, aktualna dokumentacja nie zawiera szablonów promptów ani funkcji narzędziowych dla tego serwera MCP.

- Jak podłączyć DeepSeek MCP Server do FlowHunt?

Dodaj komponent MCP do swojego przepływu w FlowHunt, otwórz jego konfigurację i wstaw dane serwera MCP w sekcji konfiguracji systemu MCP, używając podanego formatu JSON.

Zintegruj DeepSeek ze swoimi przepływami AI

Doświadcz bezpiecznego, skalowalnego i dbającego o prywatność dostępu do potężnych modeli językowych DeepSeek dzięki DeepSeek MCP Server. Idealny dla deweloperów, badaczy oraz twórców narzędzi AI.