Redes de Crença Profunda (DBNs)

As Redes de Crença Profunda (DBNs) são modelos generativos de aprendizado profundo compostos por RBMs empilhadas, destacando-se na aprendizagem de representações hierárquicas de dados para diversas tarefas de IA.

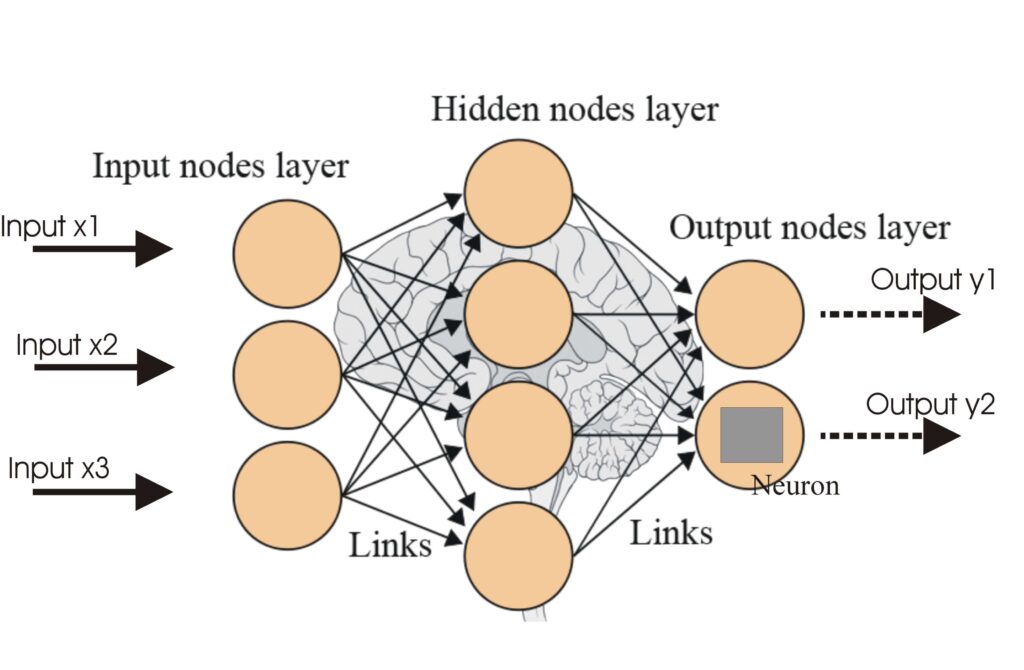

Uma Rede de Crença Profunda (DBN) é um sofisticado modelo generativo que utiliza uma arquitetura profunda para aprender representações hierárquicas de dados. As DBNs são compostas por múltiplas camadas de variáveis latentes estocásticas, utilizando principalmente Máquinas de Boltzmann Restritas (RBMs) como blocos de construção. Essas redes são projetadas para resolver desafios enfrentados por redes neurais tradicionais, como taxas de aprendizado lentas e aprisionamento em mínimos locais devido à má seleção de parâmetros. As DBNs se destacam em tarefas de aprendizado supervisionado e não supervisionado, tornando-se ferramentas versáteis para várias aplicações em aprendizado profundo.

Conceitos-chave

- Máquinas de Boltzmann Restritas (RBMs):

- As RBMs são redes neurais probabilísticas de duas camadas consistindo em uma camada visível (dados de entrada) e uma camada oculta (características detectadas dos dados).

- Elas servem como componentes fundamentais das DBNs, aprendendo distribuições de probabilidade sobre suas entradas.

- A arquitetura de uma RBM permite modelar dependências complexas entre unidades visíveis e ocultas, facilitando o aprendizado de padrões intrincados dos dados.

- Unidades Estocásticas:

- As unidades nas DBNs são estocásticas, ou seja, tomam decisões probabilísticas em vez de determinísticas.

- Essa natureza estocástica permite que a rede explore uma gama mais ampla de soluções possíveis, capturando padrões mais complexos nos dados.

- Treinamento Camada a Camada:

- As DBNs são treinadas de forma gananciosa, camada por camada. Cada camada é treinada independentemente como uma RBM para aprender as características dos dados.

- Essa abordagem simplifica o processo de treinamento e inicializa eficientemente os pesos da rede, estabelecendo uma base sólida para o ajuste fino posterior.

- Divergência Contrastiva:

- A divergência contrastiva é um algoritmo popular utilizado para treinar RBMs.

- Ela opera por meio de uma série de fases positivas e negativas para ajustar os pesos e vieses, maximizando a probabilidade dos dados de treinamento e aprimorando o poder de representação do modelo.

- Modelo Baseado em Energia:

- Cada RBM em uma DBN utiliza uma função de energia para modelar a relação entre unidades visíveis e ocultas.

- O objetivo da rede é minimizar essa energia, gerando assim representações precisas dos dados de entrada.

Como Funcionam as Redes de Crença Profunda

As DBNs operam através de duas fases principais: pré-treinamento e ajuste fino.

- Pré-treinamento: Nesta fase de aprendizado não supervisionado, cada camada da DBN é tratada como uma RBM e treinada de forma independente. Esta etapa é crucial para a inicialização dos pesos, permitindo que a rede capture de forma eficaz a estrutura subjacente dos dados.

- Ajuste fino: Após o pré-treinamento, a rede passa pelo ajuste fino utilizando dados rotulados. Isso envolve aprendizado supervisionado, onde a retropropagação é empregada para refinar os pesos em todas as camadas, aprimorando o desempenho da rede para tarefas específicas como classificação ou regressão.

Aplicações das Redes de Crença Profunda

As DBNs são especialmente eficazes em tarefas que envolvem dados de alta dimensão ou em situações onde há escassez de dados rotulados. Aplicações notáveis incluem:

- Reconhecimento de Imagens: As DBNs podem aprender a reconhecer padrões e características em imagens, sendo úteis em tarefas como reconhecimento facial e detecção de objetos.

- Reconhecimento de Fala: Sua capacidade de modelar distribuições complexas de dados permite que as DBNs reconheçam padrões de fala e transcrevam dados de áudio de forma eficaz.

- Geração de Dados: Como modelos generativos, as DBNs podem criar novas amostras de dados que imitam os dados de treinamento, o que é valioso para aumento e simulação de dados.

Exemplo: Implementando uma Rede de Crença Profunda

Considere o seguinte exemplo em Python, que demonstra o treinamento e a avaliação de uma DBN no conjunto de dados MNIST, um benchmark para tarefas de classificação de imagens:

import numpy as np

from sklearn.datasets import fetch_openml

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.neural_network import BernoulliRBM

from sklearn.pipeline import Pipeline

from sklearn.linear_model import LogisticRegression

# Carregar conjunto de dados

mnist = fetch_openml('mnist_784', version=1)

X, y = mnist['data'], mnist['target']

# Dividir conjunto em treino e teste

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Pré-processar dados com normalização

scaler = StandardScaler()

X_train_scaled = scaler.fit_transform(X_train)

X_test_scaled = scaler.transform(X_test)

# Inicializar modelo RBM

rbm = BernoulliRBM(n_components=256, learning_rate=0.01, n_iter=20)

# Inicializar modelo de regressão logística

logistic = LogisticRegression(max_iter=1000)

# Criar pipeline para extração de características e classificação

dbn_pipeline = Pipeline(steps=[('rbm', rbm), ('logistic', logistic)])

# Treinar a DBN

dbn_pipeline.fit(X_train_scaled, y_train)

# Avaliar o modelo

dbn_score = dbn_pipeline.score(X_test_scaled, y_test)

print(f"DBN Classification score: {dbn_score}")

Este código em Python ilustra como utilizar uma DBN para classificação de imagens usando o conjunto de dados MNIST. O pipeline combina uma RBM para extração de características com regressão logística para classificação, demonstrando a aplicação prática das DBNs em tarefas de aprendizado de máquina.

Redes de Crença Profunda (DBNs) e Suas Aplicações

As Redes de Crença Profunda (DBNs) são uma classe de modelos de aprendizado profundo que ganharam destaque por sua capacidade de modelar distribuições de probabilidade complexas. Essas redes são compostas por múltiplas camadas de variáveis latentes estocásticas e são tipicamente treinadas usando técnicas de aprendizado não supervisionado. A seguir, um resumo de alguns artigos científicos importantes sobre DBNs:

Learning the Structure of Deep Sparse Graphical Models

- Autores: Ryan Prescott Adams, Hanna M. Wallach, Zoubin Ghahramani (2010)

- Este artigo discute os desafios de aprender a estrutura de redes de crença com unidades ocultas. Os autores introduzem o cascading Indian buffet process (CIBP), um prior não paramétrico sobre a estrutura de redes de crença que permite um número ilimitado de camadas e unidades. O estudo mostra como o CIBP pode ser aplicado a redes de crença gaussianas para conjuntos de dados de imagem.

- Leia mais

Distinction between features extracted using deep belief networks

- Autores: Mohammad Pezeshki, Sajjad Gholami, Ahmad Nickabadi (2014)

- Esta pesquisa foca na representação de dados usando DBNs e explora métodos para distinguir características baseando-se em sua relevância para tarefas específicas de aprendizado de máquina, como reconhecimento facial. Os autores propõem dois métodos para melhorar a relevância das características extraídas por DBNs.

- Leia mais

Feature versus Raw Sequence: Deep Learning Comparative Study on Predicting Pre-miRNA

- Autores: Jaya Thomas, Sonia Thomas, Lee Sael (2017)

- O estudo compara a eficácia de DBNs baseadas em características com redes neurais convolucionais baseadas em sequência bruta para previsão de pré-miRNA. Os resultados sugerem que, com dados suficientes, modelos baseados em sequência bruta podem apresentar um desempenho comparável ou superior ao de DBNs baseadas em características, destacando o potencial dos modelos baseados em sequência em aplicações de aprendizado profundo.

- Leia mais

Esses artigos refletem a versatilidade e a evolução contínua das DBNs, desde seus processos de aprendizado estrutural até sua aplicação na extração de características e em tarefas de previsão de sequência. Eles ressaltam a importância das DBNs no avanço das técnicas de aprendizado de máquina e sua adaptabilidade a diferentes representações de dados.

Perguntas frequentes

- O que é uma Rede de Crença Profunda (DBN)?

Uma Rede de Crença Profunda é um modelo generativo de aprendizado profundo composto por múltiplas camadas de variáveis latentes estocásticas, utilizando principalmente Máquinas de Boltzmann Restritas. As DBNs aprendem representações hierárquicas dos dados e podem ser aplicadas tanto em tarefas supervisionadas quanto não supervisionadas.

- Quais são as principais aplicações das Redes de Crença Profunda?

As DBNs são utilizadas para reconhecimento de imagens, reconhecimento de fala e geração de dados. Elas se destacam no tratamento de dados de alta dimensão e em situações com poucos dados rotulados.

- Como as Redes de Crença Profunda são treinadas?

As DBNs são treinadas em duas fases: pré-treinamento não supervisionado, no qual cada camada é treinada independentemente como uma RBM, e ajuste fino supervisionado, onde a rede é otimizada usando dados rotulados por meio de retropropagação.

- O que diferencia as DBNs das redes neurais tradicionais?

As DBNs utilizam uma abordagem de treinamento camada a camada, de forma gananciosa, e empregam unidades estocásticas, permitindo melhor inicialização dos pesos e superando desafios como taxas de aprendizado lentas e mínimos locais que afetam as redes neurais tradicionais.

Experimente o FlowHunt para Soluções em Deep Learning

Comece a construir soluções de IA usando modelos avançados como Redes de Crença Profunda. Experimente a plataforma integrada do FlowHunt para suas necessidades em aprendizado de máquina.