Torch

Torch é uma biblioteca de aprendizado de máquina baseada em Lua e de código aberto, oferecendo ferramentas completas para redes neurais e deep learning, pavimentando o caminho para o PyTorch.

Torch é uma biblioteca de aprendizado de máquina de código aberto, framework de computação científica e linguagem de script baseada em Lua, otimizada especialmente para tarefas de deep learning e inteligência artificial. Inicialmente desenvolvida pelo Idiap Research Institute no EPFL em 2002, a Torch oferece um conjunto abrangente de ferramentas para construção e treinamento de redes neurais complexas. Foi precursora da biblioteca PyTorch, que desde então se tornou mais proeminente na comunidade de aprendizado de máquina. Apesar de sua influência inicial e capacidades, a dependência da Torch no Lua, uma linguagem menos difundida em comparação ao Python, limitou sua adoção em larga escala.

Componentes Principais

Arrays N-dimensionais (Tensores):

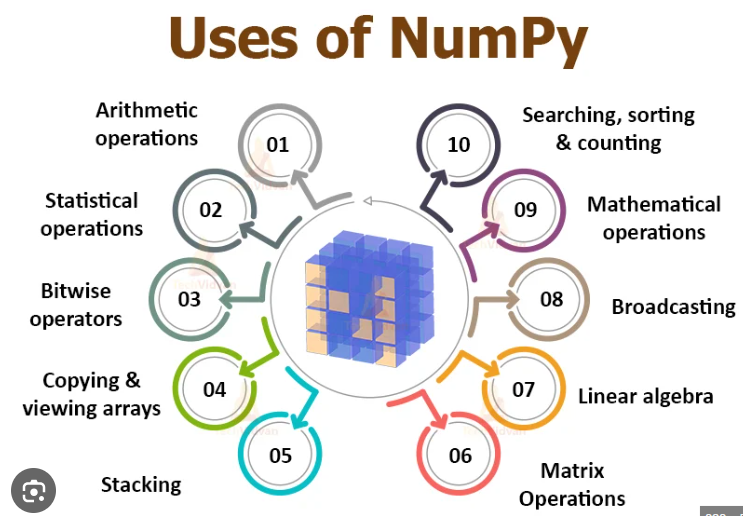

A Torch é construída em torno do conceito de Tensores, que são arrays multidimensionais semelhantes aos arrays do NumPy. Esses tensores são fundamentais para realizar diversas operações matemáticas necessárias em aprendizado de máquina e computação científica. Os tensores permitem cálculos numéricos eficientes e suportam operações tanto em CPUs quanto em GPUs através de bibliotecas otimizadas como CUDA.Diferenciação Automática:

Um recurso central da Torch, permitindo o cálculo eficiente de gradientes, crucial para o treinamento de redes neurais profundas. A diferenciação automática da Torch é implementada por meio de uma interface de módulos que permite o cálculo de gradientes de primeira ordem. Essa capacidade simplifica o processo de treinamento de modelos complexos ao automatizar o cálculo das derivadas.Módulos para Redes Neurais Profundas:

O pacotennda Torch permite a construção de redes neurais utilizando uma abordagem modular. Ele suporta redes feedforward, convolucionais e recorrentes, entre outras, e inclui módulos para funções de ativação, funções de perda e otimizadores. Esse design modular facilita a criação e experimentação com diferentes arquiteturas de redes.Aceleração por GPU:

A Torch utiliza a aceleração por GPU para realizar cálculos de forma eficiente, tornando-se adequada para tarefas de aprendizado de máquina em larga escala. Sua integração com CUDA proporciona melhorias significativas de desempenho, permitindo que pesquisadores treinem modelos complexos de maneira mais rápida e eficaz.

Casos de Uso

Pesquisa em Deep Learning:

A Torch foi amplamente utilizada em ambientes acadêmicos e industriais, especialmente no desenvolvimento de novos algoritmos de deep learning. Sua flexibilidade e velocidade a tornam ideal para prototipagem de modelos complexos. Pesquisadores utilizaram a Torch para experimentar com arquiteturas e algoritmos de aprendizado inovadores.Visão Computacional:

A Torch oferece ferramentas para processamento de imagens e aplicações de visão computacional, como detecção de objetos e classificação de imagens. Suas capacidades para lidar com grandes conjuntos de dados e processamento em tempo real a tornam uma ferramenta valiosa para análise visual de dados.Processamento de Linguagem Natural (PLN):

A biblioteca suporta o desenvolvimento de modelos de PLN, incluindo redes neurais recorrentes e modelos de linguagem, essenciais para tarefas como tradução automática e análise de sentimento. As capacidades dinâmicas de computação da Torch permitem lidar com dados sequenciais e entradas de tamanho variável de forma eficaz.Aprendizado por Reforço:

A Torch é utilizada em aprendizado por reforço para desenvolver modelos que aprendem ações ótimas por tentativa e erro, sendo útil em áreas como robótica e IA para jogos. Sua capacidade de gerenciar ambientes e processos complexos auxilia no desenvolvimento de sistemas inteligentes e adaptativos.

Exemplos e Aplicações

Construção de Redes Neurais:

O pacotennda Torch permite que usuários construam redes neurais por meio de uma interface de alto nível. Por exemplo, criar um perceptron multicamadas simples pode ser feito com poucas linhas de código, definindo camadas e funções de ativação de forma integrada.local nn = require 'nn' local model = nn.Sequential() model:add(nn.Linear(10, 25)) model:add(nn.Tanh()) model:add(nn.Linear(25, 1))Visão Computacional com Torch:

O Facebook AI Research utilizou a Torch em diversos projetos de visão computacional, aproveitando sua robustez para processar e analisar grandes conjuntos de dados de forma eficiente. As capacidades de GPU da Torch permitem processamento de imagens em tempo real, tornando-a uma escolha preferencial para tarefas de visão de alto desempenho.Modelos de PLN:

O suporte da Torch para redes neurais dinâmicas a torna ideal para o desenvolvimento de modelos avançados de PLN que exigem flexibilidade no processamento de sequências de texto. A capacidade do framework de lidar com tamanhos de entrada variáveis e tipos de dados dinâmicos é crucial para aplicações sofisticadas de processamento de linguagem.

Transição para o PyTorch

O desenvolvimento da Torch foi, em grande parte, sucedido pelo PyTorch, uma biblioteca que mantém as funcionalidades centrais da Torch, mas aproveita a popularidade e usabilidade do Python. O PyTorch oferece uma interface mais intuitiva e melhor integração com o ecossistema Python, tornando-se a escolha preferida para profissionais de aprendizado de máquina modernos. O grafo dinâmico de computação e a API de alto nível do PyTorch o tornaram padrão no campo, facilitando a prototipagem e implantação rápida de modelos de deep learning.

Integração com IA e Chatbots

Torch, e seu sucessor PyTorch, são fundamentais no desenvolvimento de aplicações de IA, incluindo chatbots. A capacidade de processar grandes volumes de dados e aprender dinamicamente com eles é essencial para criar sistemas inteligentes capazes de compreender e responder efetivamente às entradas dos usuários. Com os avanços em PLN e deep learning, o PyTorch continua sendo uma ferramenta central para aprimorar a inteligência e eficiência dos sistemas de chatbot.

Pesquisas sobre a Biblioteca Torch

A biblioteca Torch é uma popular biblioteca de aprendizado de máquina amplamente utilizada para implementação de modelos de deep learning. Abaixo está um resumo dos principais artigos de pesquisa que discutem a biblioteca Torch e suas aplicações:

Torch-Struct: Deep Structured Prediction Library

Publicado em 2020 por Alexander M. Rush, este artigo apresenta o Torch-Struct, uma biblioteca desenvolvida para previsão estruturada em frameworks de deep learning. Ela se integra a frameworks vetorizados baseados em diferenciação automática e inclui uma coleção ampla de estruturas probabilísticas. O objetivo da biblioteca é oferecer código eficiente, testável e rápido por meio de operações em lote e vetorizadas. Os experimentos demonstram ganhos significativos de desempenho em relação a bases rápidas. Para mais detalhes, acesse o artigo aqui.rnn para tarefas de dados sequenciais como PLN, reconhecimento de fala e previsão de séries temporais. Explore agora!"): Biblioteca Recorrente para Torch

Escrito por Nicholas Léonard e outros em 2015, este artigo discute o pacote rnn, que oferece componentes para uma ampla gama de Redes Neurais Recorrentes dentro do framework Torch. O pacote enfatiza testes unitários robustos e compatibilidade retroativa. Passou por três iterações, aumentando sua flexibilidade e capacidade. Este artigo compara o pacote rnn com implementações existentes, fornecendo insights sobre seu desenvolvimento e uso.cltorch: um Backend Agnóstico de Hardware para a Biblioteca Torch de Redes Neurais Profundas, Baseado em OpenCL

Escrito por Hugh Perkins em 2016, este artigo apresenta o cltorch, que permite o treinamento de redes neurais profundas em GPUs de diferentes fabricantes utilizando OpenCL. O cltorch pode executar modelos como AlexNet e GoogleNet, focando na aceleração de camadas convolucionais para melhor desempenho agnóstico de hardware. O artigo também discute desafios técnicos e soluções para uma implementação rápida.cito: Um pacote R para treinar redes neurais usando torch

Publicado em 2024 por Christian Amesoeder e colegas, este artigo apresenta o ‘cito’, um pacote R que simplifica a especificação de Redes Neurais Profundas utilizando a sintaxe de fórmulas já conhecida dos pacotes R. Ele utiliza a biblioteca Torch para otimização numérica e visa tornar o deep learning mais acessível aos usuários de R, especialmente na área de ecologia.

Perguntas frequentes

- O que é o Torch?

Torch é uma biblioteca de aprendizado de máquina de código aberto e framework de computação científica baseada em Lua, otimizada para deep learning e inteligência artificial. Oferece ferramentas para construir e treinar redes neurais complexas e foi precursora do PyTorch.

- Quais são as principais características do Torch?

Torch oferece computação de tensores N-dimensionais, diferenciação automática, componentes modulares para redes neurais e aceleração por GPU para tarefas de deep learning de alto desempenho.

- Como o Torch difere do PyTorch?

Torch é baseado em Lua e foi um dos primeiros frameworks de deep learning, enquanto o PyTorch é seu sucessor baseado em Python, oferecendo uma API mais intuitiva, grafos de computação dinâmicos e ampla adoção pela comunidade de aprendizado de máquina.

- Quais são os casos de uso comuns do Torch?

Torch foi utilizado em pesquisas de deep learning, visão computacional, processamento de linguagem natural e aprendizado por reforço, especialmente antes do crescimento do PyTorch.

- Por que a comunidade migrou do Torch para o PyTorch?

A transição ocorreu porque Python é mais utilizado que Lua, e o PyTorch oferece maior usabilidade, integração com o ecossistema Python e recursos avançados para fluxos modernos de deep learning.

Comece a Construir com IA

Descubra como Torch e outras ferramentas de IA podem potencializar seus projetos de deep learning e aprendizado de máquina. Experimente a plataforma FlowHunt para criar suas próprias soluções de IA.