Servidor OpenAI WebSearch MCP

Conecte seus agentes de IA à web ao vivo com o Servidor OpenAI WebSearch MCP, garantindo respostas em tempo real, precisas e sensíveis à localização para seus usuários.

O que faz o Servidor “OpenAI WebSearch” MCP?

O Servidor OpenAI WebSearch MCP permite que assistentes de IA acessem a funcionalidade de busca na web da OpenAI via Model Context Protocol (MCP). Atuando como uma ponte entre modelos de IA e informações em tempo real da web, este servidor possibilita que assistentes recuperem dados atualizados que podem não estar presentes em seu corpus de treinamento. Desenvolvedores podem integrar este servidor a plataformas como Claude ou Zed, equipando seus agentes de IA com a capacidade de realizar buscas ao vivo durante conversas. Isso amplia significativamente casos de uso como responder perguntas sobre eventos atuais, enriquecer o contexto com dados recentes e fornecer um fluxo de desenvolvimento de IA mais dinâmico e informado.

Lista de Prompts

Nenhum template de prompt listado no repositório ou documentação.

Lista de Recursos

Nenhum recurso explícito listado no repositório ou documentação.

Lista de Ferramentas

- web_search

Permite que a IA utilize a busca na web da OpenAI como ferramenta.- Argumentos obrigatórios:

type(string): Deve ser “web_search_preview”.search_context_size(string): Orientação para uso da janela de contexto—pode ser “low”, “medium” (padrão) ou “high”.user_location(objeto ou nulo): Contém informações de localização (tipo, cidade, país, região, fuso horário) para personalizar buscas.

- Argumentos obrigatórios:

Casos de Uso deste Servidor MCP

- Responder a Eventos Atuais:

Permite que assistentes de IA forneçam respostas atualizadas pesquisando na web por informações recentes em vez de depender apenas de dados de treinamento estáticos. - Assistência à Pesquisa:

Oferece capacidade de busca ao vivo para usuários que procuram fatos detalhados em tempo real ou resumos sobre uma ampla variedade de tópicos. - Enriquecimento de Contexto:

Suplementa as respostas dos LLMs com dados frescos da web, aumentando a relevância e precisão das respostas. - Busca com Consciência de Localização:

Utiliza detalhes de localização fornecidos pelo usuário para personalizar resultados de busca, tornando as respostas mais apropriadas ao contexto. - Depuração e Desenvolvimento:

Inspecione e depure facilmente o servidor MCP usando a ferramenta MCP inspector, facilitando integração e solução de problemas.

Como configurar

Windsurf

Em breve (nenhum passo fornecido na documentação atualmente).

Claude

- Obtenha sua chave de API da OpenAI na plataforma da OpenAI.

- Execute o seguinte comando para instalar e auto-configurar o servidor:

OPENAI_API_KEY=sk-xxxx uv run --with uv --with openai-websearch-mcp openai-websearch-mcp-install - Alternativamente, instale o

uvxe edite as configurações do Claude:"mcpServers": { "openai-websearch-mcp": { "command": "uvx", "args": ["openai-websearch-mcp"], "env": { "OPENAI_API_KEY": "sua-chave-api-aqui" } } } - Ou instale via pip:

E atualize as configurações:pip install openai-websearch-mcp"mcpServers": { "openai-websearch-mcp": { "command": "python", "args": ["-m", "openai_websearch_mcp"], "env": { "OPENAI_API_KEY": "sua-chave-api-aqui" } } } - Salve a configuração e reinicie o Claude se necessário.

Protegendo as Chaves de API:

Armazene as chaves de API utilizando o campo env na sua configuração.

Exemplo:

"env": {

"OPENAI_API_KEY": "sua-chave-api-aqui"

}

Cursor

Em breve (nenhum passo fornecido na documentação atualmente).

Cline

Nenhuma instrução de configuração fornecida na documentação.

Zed

- Obtenha sua chave de API da OpenAI.

- Usando

uvx, adicione ao seusettings.jsondo Zed:"context_servers": [ "openai-websearch-mcp": { "command": "uvx", "args": ["openai-websearch-mcp"], "env": { "OPENAI_API_KEY": "sua-chave-api-aqui" } } ], - Ou com instalação via pip:

"context_servers": { "openai-websearch-mcp": { "command": "python", "args": ["-m", "openai_websearch_mcp"], "env": { "OPENAI_API_KEY": "sua-chave-api-aqui" } } }, - Salve sua configuração e reinicie o Zed.

Protegendo as Chaves de API:

Use o campo env como mostrado acima.

Como usar este MCP em fluxos

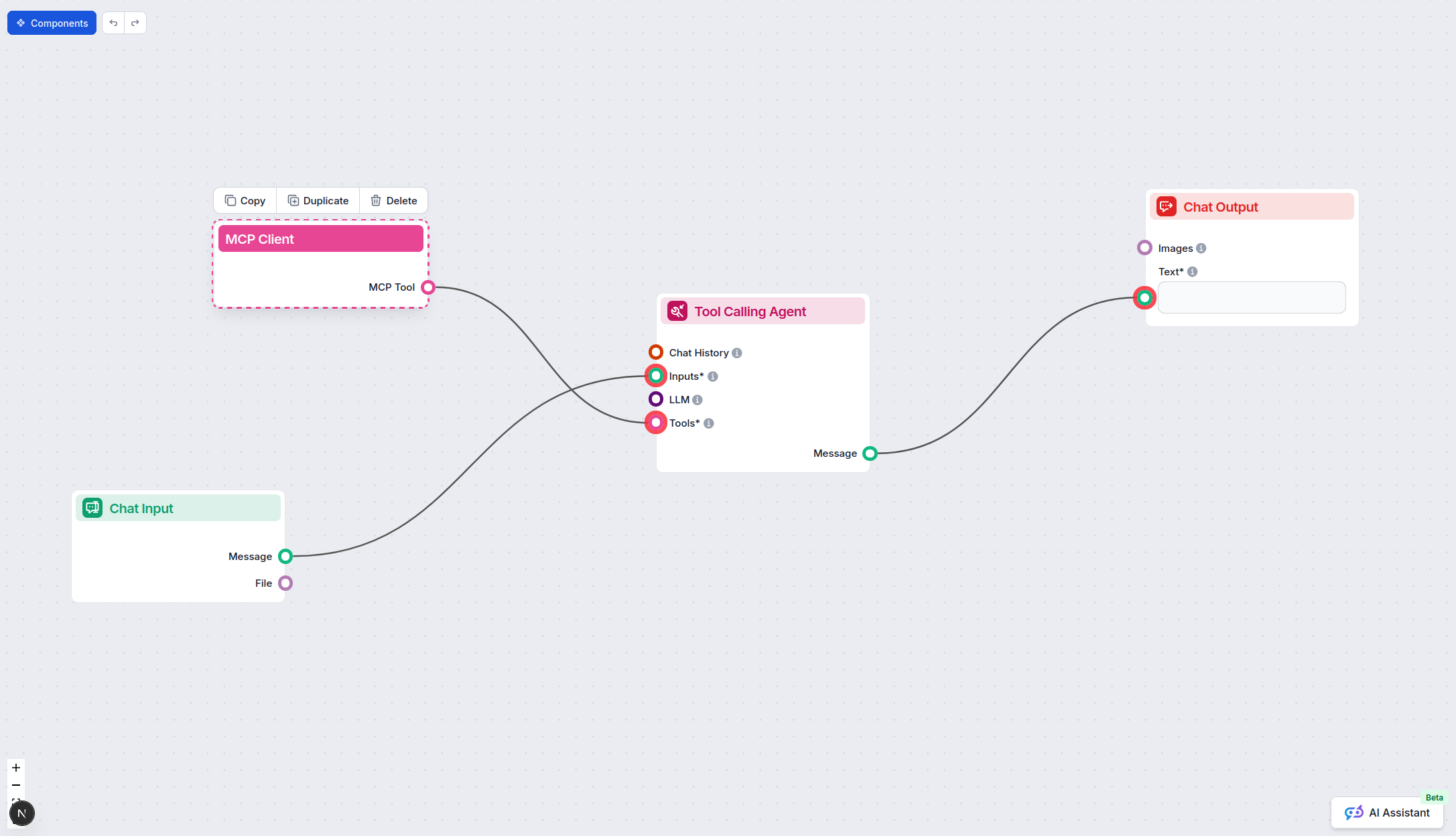

Usando MCP no FlowHunt

Para integrar servidores MCP no seu fluxo do FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração MCP do sistema, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"openai-websearch-mcp": {

"transport": "streamable_http",

"url": "https://seumcpserver.exemplo/caminhoparamcp/url"

}

}

Uma vez configurado, o agente de IA agora pode usar este MCP como ferramenta, com acesso a todas as suas funções e capacidades. Lembre-se de trocar “openai-websearch-mcp” pelo nome real do seu servidor MCP e substituir a URL pela sua própria URL MCP.

Visão Geral

| Seção | Disponível | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | Encontrado em README.md |

| Lista de Prompts | ⛔ | Nenhum template de prompt listado |

| Lista de Recursos | ⛔ | Nenhum recurso explícito listado |

| Lista de Ferramentas | ✅ | Ferramenta web_search descrita |

| Protegendo as Chaves de API | ✅ | Uso detalhado de campos env nas configurações JSON |

| Suporte a Amostragem (menos relevante na avaliação) | ⛔ | Não mencionado |

Entre estas tabelas:

Este servidor MCP é focado e bem documentado para seu caso de uso principal (acesso à busca na web para LLMs), mas carece de recursos MCP avançados como prompts personalizados, recursos explícitos ou suporte a sampling/roots. No geral, é robusto para o cenário pretendido, mas limitado em extensibilidade. Avaliação: 5/10

Pontuação MCP

| Possui uma LICENSE | ✅ (MIT) |

|---|---|

| Possui ao menos uma ferramenta | ✅ |

| Número de Forks | 10 |

| Número de Stars | 43 |

Perguntas frequentes

- O que faz o Servidor OpenAI WebSearch MCP?

Ele permite que assistentes de IA realizem buscas na web ao vivo e em tempo real usando a API de busca da OpenAI, possibilitando acesso a informações atuais e respostas sobre eventos recentes, fatos e muito mais.

- Quais plataformas podem usar este servidor MCP?

Pode ser integrado a plataformas como FlowHunt, Claude, Zed e qualquer ambiente que suporte o Model Context Protocol (MCP).

- A segurança da chave de API é suportada?

Sim. As chaves de API são definidas por variáveis de ambiente na configuração para todas as plataformas suportadas, mantendo-as seguras.

- Quais são os principais casos de uso?

Perguntas e respostas sobre eventos atuais, assistência à pesquisa, enriquecimento de contexto da IA com dados frescos da web e personalização de respostas com base na localização do usuário.

- Há suporte para busca com consciência de localização?

Sim. Você pode fornecer detalhes de localização do usuário nos argumentos da ferramenta para obter resultados de busca mais relevantes e localizados.

- Quais ferramentas o servidor oferece?

Ele fornece uma ferramenta 'web_search', permitindo que IAs consultem a web em tempo real, com opções para tamanho de contexto e localização.

Impulsione a IA com Busca na Web em Tempo Real

Dê aos seus agentes de IA no FlowHunt conhecimento do mundo real com o Servidor OpenAI WebSearch MCP. Comece agora para desbloquear eventos atuais, assistência à pesquisa e muito mais.